BERT là gì? Khám phá sức mạnh của mô hình ngôn ngữ đến từ Google

BERT đã mang lại đột phá lớn trong lĩnh vực này nhờ vào khả năng hiểu ngữ nghĩa văn bản một cách toàn diện.

Được phát triển bởi Google, BERT là một trong những mô hình ngôn ngữ nổi bật nhất hiện nay, mang lại đột phá trong lĩnh vực xử lý ngôn ngữ tự nhiên (NLP). Với khả năng hiểu và phân tích ngữ nghĩa của văn bản một cách toàn diện, BERT nâng cấp khả năng xử lý ngôn ngữ và tương tác với con người của AI, từ việc tìm kiếm thông tin đến việc trả lời câu hỏi, phân loại văn bản. Vậy BERT là gì và tại sao nó lại quan trọng trong sự phát triển của trí tuệ nhân tạo? Hãy cùng VNPT AI khám phá những điểm nổi bật và ứng dụng của mô hình này ngay dưới đây nhé!

BERT là gì?

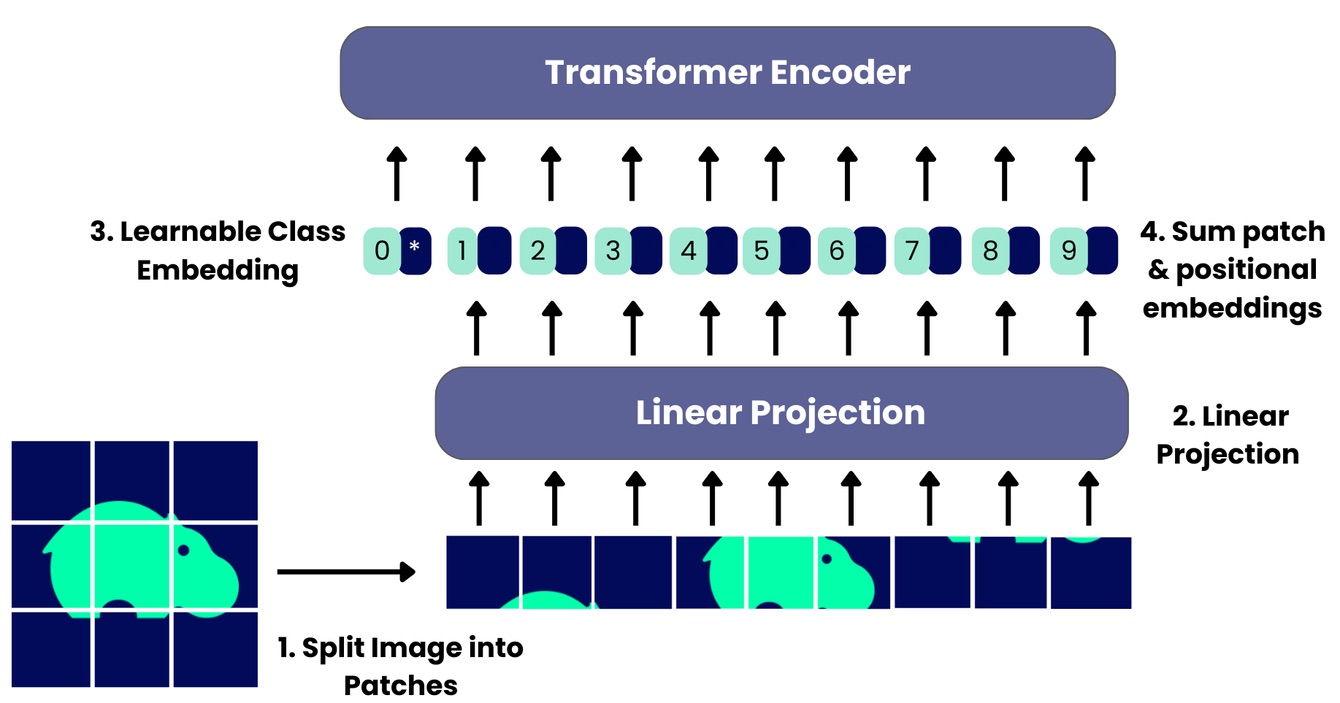

BERT (Bidirectional Encoder Representations from Transformers) là một mô hình học sâu được phát triển bởi Google, đặc biệt nổi bật trong việc xử lý ngôn ngữ tự nhiên (NLP). Mô hình BERT sử dụng kiến trúc Transformer - một kiến trúc mạng nơ-ron tiên tiến dựa trên cơ chế attention để hiểu ngữ nghĩa của từ trong ngữ cảnh đầy đủ, thay vì chỉ dựa vào từ đứng trước hoặc sau trong câu. Đây chính là điểm khác biệt quan trọng giúp cho BERT có thể hiểu và xử lý ngữ nghĩa của câu tốt hơn, từ đó mang lại những kết quả vượt trội khi ứng dụng BERT trong NLP.

Nguyên lý hoạt động của BERT

Về cơ chế hoạt động cơ bản

BERT sử dụng kiến trúc Transformer với cơ chế self-attention, cho phép mô hình xem xét toàn bộ câu cùng một lúc. Nhờ đó BERT có thể hiểu mối quan hệ giữa các từ trước và sau, cho phép mô hình hiểu rõ hơn về ngữ nghĩa của từng từ trong ngữ cảnh đầy đủ của câu.

Quá trình tiền huấn luyện (pre-training) và tinh chỉnh (fine-tuning).

Nhờ trải qua quá trình huấn luyện trước, BERT đã có lớp kiến thức nền tảng để xây dựng các phản hồi của mình. Bên cạnh đó, mô hình này còn có thể thích ứng với lượng nội dung và các truy vấn tìm kiếm ngày càng lớn cũng như được tinh chỉnh để phù hợp với yêu cầu của người dùng.

BERT đã được huấn luyện trước trong bốn ngày trên Wikipedia (~2,5 tỷ từ) và BooksCorpus của Google (~800 triệu từ). Điều này cho phép mô hình thu thập kiến thức không chỉ bằng tiếng Anh mà còn bằng nhiều ngôn ngữ khác trên khắp thế giới.

Mô hình sử dụng hai kỹ thuật chính để học hiểu ngôn ngữ là Masked Language Model (MLM) và Next Sentence Prediction (NSP). Cụ thể:

- Masked Language Model (Mô hình ngôn ngữ bị che dấu): BERT sử dụng kỹ thuật MLM để dự đoán từ bị che đi trong một câu, giúp mô hình học cách hiểu từ theo ngữ cảnh thay vì gắn một nghĩa cố định cho từ.

- Next Sentence Prediction (Dự đoán câu tiếp theo): Đây là kỹ thuật huấn luyện giúp BERT xác định xem một câu có liên quan đến câu trước đó hay không. Nhờ kỹ thuật này, BERT có thể hiểu rõ hơn về mối quan hệ giữa các câu và ngữ cảnh của câu.

Sau giai đoạn tiền huấn luyện, BERT sẽ được tinh chỉnh cho các nhiệm vụ cụ thể như phân loại văn bản, trả lời câu hỏi hoặc nhận diện thực thể. Giai đoạn này yêu cầu ít dữ liệu hơn và có thể được thực hiện nhanh chóng hơn. Để tránh các tương tác không cần thiết và tốn kém trong suốt quá trình huấn luyện, Google đã đã sử dụng kỹ thuật học chuyển giao (transfer learning) để tận dụng mô hình BERT đã huấn luyện trước, giúp tinh chỉnh nhanh hơn và đạt hiệu quả cao hơn trong các tác vụ cụ thể.

Cấu trúc của mô hình BERT bao gồm những gì?

Cấu trúc của BERT là một bộ mã hóa Transformer đa lớp với khả năng xử lý dữ liệu theo cả hai chiều, về cơ bản nó tương tự như mô hình Transformer gốc. Mô hình Transformer BERT bao gồm hai phần chính là encoder và decoder với cơ chế self-attention trong phần encoder và cơ chế attention trong phần decoder. Tuy nhiên, khi ứng dụng BERT trong xử lý ngôn ngữ tự nhiên chỉ sử dụng phần encoder của Transformer để thực hiện các tác vụ.

Cụ thể, BERT có hai phiên bản chính:

- BERTBASE: Bao gồm 12 lớp encoder và mỗi lớp có 12 đầu attention, 768 đơn vị ẩn trong mạng feedforward, 110 triệu tham số.

- BERTLARGE: Phiên bản lớn hơn của BERTBASE có 24 lớp encoder với mỗi lớp có 16 đầu attention và 1024 đơn vị ẩn trong mạng feedforward, 340 triệu tham số.

So với mô hình Transformer gốc chỉ có 6 lớp encoder, 8 đầu attention và 512 đơn vị ẩn, BERTBASE và BERTLARGE có cấu trúc mạnh mẽ hơn với số lượng lớp nhiều hơn và số lượng đầu attention cũng lớn hơn nên mô hình có khả năng xử lý ngữ nghĩa tốt hơn.

Sự khác nhau giữa BERT và Generative Pre-trained Transformer (GPT)

Cả BERT và GPT đều được xây dựng dựa trên mô hình Transformer, nhưng chúng có những đặc trưng riêng biệt về kiến trúc, cách huấn luyện và ứng dụng:

Tiêu chí | BERT | GPT |

Kiến trúc | Thiết kế học song phương, sử dụng mô hình ngôn ngữ bị ẩn (Masked Language Model) để dự đoán từ thiếu trong câu dựa trên ngữ cảnh cả hai chiều (trái và phải). | Thiết kế cho mô hình ngôn ngữ sinh(Generative Language Modeling), dự đoán từ tiếp theo trong câu dựa trên ngữ cảnh phía trước, sử dụng phương pháp autoregressive (một chiều). |

Mục tiêu huấn luyện | Dựa theo mục tiêu masked language model và next sentence prediction nhằm nắm bắt ngữ cảnh song phương và hiểu mối quan hệ giữa các từ trong câu. | Dự đoán từ tiếp theo trong câu giúp mô hình học cách tạo ra các chuỗi văn bản phù hợp ngữ cảnh. |

Hiểu ngữ cảnh | Hiệu quả trong các tác vụ yêu cầu hiểu sâu về ngữ cảnh và mối quan hệ giữa các từ trong câu như phân loại văn bản, nhận diện thực thể, trả lời câu hỏi. | Mạnh về tạo ra văn bản mạch lạc, phù hợp ngữ cảnh, thường được sử dụng cho các tác vụ sáng tạo, hệ thống đối thoại, và tạo ra các chuỗi ngôn ngữ tự nhiên. |

Loại tác vụ và ứng dụng | Thường được sử dụng cho các tác vụ như phân loại văn bản, nhận diện thực thể, phân tích cảm xúc, trả lời câu hỏi. | Thường được ứng dụng trong các tác vụ như tạo văn bản, hệ thống đối thoại, tóm tắt văn bản, viết sáng tạo. |

Phương pháp điều chỉnh mô hình: Fine-tuning vs Few-Shot Learning | Được tinh chỉnh trên các tác vụ cụ thể với dữ liệu có nhãn để thích ứng với các bài toán thực tế. | Được thiết kế để học ít mẫu (few-shot learning), có thể thực hiện các tác vụ mà không cần quá nhiều dữ liệu huấn luyện. |

Phương pháp xử lý văn bản | Song phương (Bidirectional): Xử lý văn bản từ trái sang phải và từ phải sang trái, sử dụng phần encoder của mô hình Transformer. | Một chiều (Unidirectional) hoặc autoregressive: Xử lý văn bản theo một chiều, sử dụng phần decoder của mô hình Transformer. |

Ứng dụng thực tế | Được áp dụng trong Gmail, Google Docs, tìm kiếm nâng cao, trợ lý giọng nói, phân tích và đánh giá khách hàng. | Được sử dụng để tạo mã ML, xây dựng ứng dụng, viết bài báo, podcast, website, và tạo tài liệu pháp lý. |

Hiệu suất | Đạt điểm số GLUE là 80.4% và độ chính xác 93.3% trên bộ dữ liệu SQuAD. | Đạt độ chính xác 76.2% trên LAMBADA với học không có giám sát (zero-shot learning) và 64.3% độ chính xác trên bộ dữ liệu TriviaQA. |

Lợi ích của mô hình BERT

Dưới đây là một số lợi ích nổi bật của BERT:

Phân loại và biểu diễn văn bản

BERT rất hiệu quả trong việc tính toán các đại diện vector cho các tác vụ downstream khác nhau. Với khả năng sử dụng encoder Transformer đa lớp song phương, BERT có thể hiểu cấu trúc ngôn ngữ và ngữ cảnh của văn bản một cách nhanh chóng nên thường ứng dụng để phân loại văn bản, nhận diện thực thể, phân tích cảm xúc.

Gán nhãn dữ liệu

BERT có thể hỗ trợ các nhà khoa học dữ liệu trong việc dự đoán nhãn cho dữ liệu chưa được gán nhãn. BERT có thể hỗ trợ các nhà khoa học dữ liệu trong việc phân loại dữ liệu chưa được gán nhãn bằng cách tinh chỉnh trên các tập dữ liệu có sẵn. Một mô hình BERT đã được huấn luyện trước có thể kết hợp với một lớp phân loại để thực hiện phân tích cảm xúc. Sau đó, các nhà khoa học dữ liệu có thể sử dụng các nhãn này để huấn luyện một mô hình phân loại nhỏ hơn, từ đó triển khai trong quy trình làm việc của doanh nghiệp.

Xếp hạng và khuyến nghị

BERT hỗ trợ cải thiện khả năng xếp hạng và gợi ý nội dung trong các hệ thống tìm kiếm và thương mại điện tử . Nhờ khả năng hiểu ngữ cảnh và mối quan hệ giữa các từ, BERT giúp nâng cao độ chính xác khi xếp hạng kết quả tìm kiếm, từ đó hiển thị những sản phẩm hoặc đánh giá phù hợp nhất với truy vấn của người dùng. Ví dụ, các doanh nghiệp như Amazon đã ứng dụng BERT để cải thiện hệ thống gợi ý sản phẩm giúp khách hàng tìm thấy sản phẩm phù hợp một cách nhanh chóng và chính xác hơn.

Hiệu quả tính toán

Trong khi các mô hình NLP phổ biến như GPT-4 và Palm 2 yêu cầu các hệ thống GPU phức tạp để tinh chỉnh và suy luận thì BERT có thể huấn luyện trên một GPU duy nhất. Thậm chí, một số phiên bản nhỏ hơn của BERT như DistilBERT và BERT-Base có thể chạy trên các thiết bị di động và các thiết bị nhúng.

Đẩy mạnh tốc độ phát triển

Các mô hình BERT đẩy nhanh quá trình triển khai và áp dụng bởi mô hình đã được huấn luyện trước, chỉ cần tinh chỉnh thay vì huấn luyện từ đầu. Đồng thời một số biến thể của BERT còn có thể giảm kích thước mô hình. Mô hình này chỉ yêu cầu một lượng nhỏ dữ liệu nội bộ và có hiệu suất tối ưu vượt trội so với các mô hình đơn giản hơn. Điều này giúp các tổ chức nhanh chóng triển khai BERT vào các ứng dụng thực tế mà không mất nhiều thời gian và tài nguyên.

Ứng dụng của BERT trong thực tế

Mô hình BERT đã và đang xuất hiện rộng rãi trong nhiều lĩnh vực đời sống từ các tác vụ văn phòng như tạo văn bản, dịch ngôn ngữ, cho tới các hệ thống chăm sóc khách hàng của doanh nghiệp,... Dưới đây là một số ứng dụng nổi bật của BERT:

- Trả lời câu hỏi: BERT thường được ứng dụng phổ biến trong các hệ thống hỗ trợ khách hàng và công cụ tìm kiếm nhờ khả năng hiểu ngữ cảnh của câu hỏi trong đoạn văn bản xung quanh và cung cấp câu trả lời chính xác.

- Phân tích cảm xúc: Trong các bài đánh giá sản phẩm, phản hồi khách hàng hay trên các nền tảng mạng xã hội, mô hình BERT có thể phân tích yếu tố trong văn bản giúp nhận diện được thái độ của người viết.

- Tạo văn bản: BERT có khả năng sinh ra các đoạn văn bản dài từ các gợi ý đơn giản hoặc văn bản tự nhiên, mạch lạc và liên kết chặt chẽ nhờ khả năng hiểu ngữ nghĩa tiên tiến.

- Tóm tắt văn bản: BERT có thể đọc và tóm tắt các văn bản phức tạp trong các lĩnh vực chuyên ngành như pháp lý và y tế giúp tối ưu đọc hiểu và khả năng tiếp cận thông tin quan trọng.

- Dịch ngôn ngữ: BERT được huấn luyện với dữ liệu đa ngôn ngữ giúp hỗ trợ dịch ngữ liệu đầu vào cho người dùng toàn cầu.

- Tự động hoàn thành tác vụ: BERT hỗ trợ các doanh nghiệp tự động hóa các tác vụ hàng ngày như gửi email, tin nhắn hoặc các dịch vụ giao tiếp. Điều này giúp tiết kiệm thời gian và tăng năng suất công việc trong môi trường kinh doanh.

- Nhận diện thực thể: Mô hình BERT có khả năng nhận diện tên thực thể trong văn bản như tên địa điểm, người, tổ chức, v.v nên thường được dùng để phân tích văn bản, quản lý thông tin hoặc các hệ thống thông minh.

- Phân loại văn bản: BERT có thể phân loại tin tức theo các chủ đề hoặc phân loại văn bản đầu vào vào các nhóm đã định trước, chẳng hạn như phân loại thư rác (spam) và không phải thư rác (not spam).

Thách thức và rủi ro khi sử dụng BERT

Mặc dù BERT là mô hình xử lý ngôn ngữ tự nhiên khá tiên tiến nhưng cũng giống như các công nghệ khác, BERT vẫn có một số hạn chế và rủi ro cần lưu ý:

- Chưa hiểu ngữ cảnh sâu sắc: BERT có thể nhận diện các mô hình và tạo ra câu văn mạch lạc nhưng nó lại gặp phải khó khăn trong việc hiểu các hàm ý hoặc ngữ cảnh phức tạp, đặc biệt là khi đối mặt với từ đồng âm và câu nói mơ hồ, thiếu rõ ràng.

- Thiếu khả năng suy luận và lý luận logic: BERT không thể thực hiện các phép suy luận cơ bản hoặc rút ra thông tin từ các nguồn không rõ ràng, dẫn đến khả năng xử lý các tác vụ yêu cầu có kiến thức nền tảng của con người còn hạn chế.

- Thiếu tính sáng tạo và độc đáo: Mặc dù BERT có thể tạo ra văn bản giống con người nhưng nó không thể sáng tạo ra ý tưởng mới hoặc khái niệm độc đáo vì mục tiêu huấn luyện chỉ tập trung vào việc dự đoán từ bị thiếu trong câu.

- Thiên lệch và thiếu công bằng: Dữ liệu huấn luyện có thể bị thiên lệch nên kết quả không đủ minh bạch, khách quan.

- Yêu cầu tài nguyên tính toán lớn và không linh hoạt: Mô hình BERT đòi hỏi tài nguyên tính toán đáng kể và cần được huấn luyện lại khi áp dụng vào các lĩnh vực mới, điều này làm giảm hiệu quả và tính linh hoạt khi triển khai vào các ứng dụng khác nhau.

Các phiên bản mở rộng của mô hình BERT

BERT là mã nguồn mở nên bất kỳ ai cũng có thể sử dụng và tùy chỉnh. Google cũng cho biết người dùng có thể huấn luyện một hệ thống hỏi đáp tiên tiến chỉ trong vòng 30 phút trên TPU (Tensor Processing Unit) của Google Cloud và trong vài giờ sử dụng GPU. Nhiều tổ chức, nhóm nghiên cứu và các bộ phận khác nhau của Google đang tinh chỉnh kiến trúc của mô hình này thông qua huấn luyện có giám sát để tối ưu hiệu nên có rất nhiều phiên bản mở rộng của BERT. Chẳng hạn như:

- PatentBERT: Phiên bản này được tinh chỉnh để thực hiện các tác vụ phân loại bằng sáng chế.

- DocBERT: Được tối ưu hóa cho các tác vụ phân loại tài liệu.

- BioBERT: Là mô hình biểu diễn ngôn ngữ sinh học dành riêng cho khai thác văn bản y học.

- VideoBERT: Mô hình ngôn ngữ-ảnh kết hợp này được sử dụng trong việc học không giám sát các dữ liệu chưa gắn nhãn từ YouTube.

- SciBERT: Phiên bản BERT được điều chỉnh cho văn bản khoa học.

- G-BERT: Mô hình BERT đã được tiền huấn luyện sử dụng mã y tế với các đại diện phân cấp thông qua mạng nơ-ron đồ thị, sau đó được tinh chỉnh để đưa ra các khuyến nghị y tế.

- TinyBERT (Huawei): Phiên bản BERT nhỏ hơn, học từ “thầy” BERT gốc, thực hiện chưng cất transformer để cải thiện hiệu quả. TinyBERT có kích thước nhỏ hơn 7,5 lần và nhanh hơn 9,4 lần so với BERT-base.

- DistilBERT (Hugging Face): Phiên bản nhỏ hơn, nhanh hơn và tiết kiệm chi phí của BERT, được huấn luyện từ BERT, sau đó loại bỏ một số khía cạnh kiến trúc để nâng cao hiệu quả.

- ALBERT: Phiên bản nhẹ hơn của BERT giúp giảm mức tiêu thụ bộ nhớ và tăng tốc độ huấn luyện mô hình.

- SpanBERT: Cải tiến khả năng dự đoán các đoạn văn bản của BERT.

- RoBERTa: Phiên bản này được huấn luyện trên một bộ dữ liệu lớn hơn và trong thời gian dài hơn để cải thiện hiệu suất so với phiên bản BERT gốc.

- ELECTRA: Phiên bản được điều chỉnh để tạo ra các đại diện văn bản chất lượng cao hơn.

Kết luận

Với những chia sẻ của VNPT AI về “BERT là gì”, chúng ta có thể thấy đây là một trong những mô hình tiên tiến và hiệu quả nhất trong lĩnh vực xử lý ngôn ngữ tự nhiên hiện nay. Với khả năng hiểu ngữ cảnh từ cả hai phía của câu, ứng dụng của BERT trong NLP ngày càng phát triển, từ tìm kiếm thông tin, trả lời câu hỏi đến phân tích cảm xúc và chatbot. Cũng vì thế, BERT được khai thác trong rất nhiều lĩnh vực như y tế, pháp lý, và giáo dục. Việc hiểu rõ về BERT và cách thức hoạt động của nó sẽ giúp chúng ta tận dụng tối đa tiềm năng của mô hình này trong các ứng dụng thực tế, nâng cao hiệu quả và độ chính xác trong các tác vụ xử lý ngôn ngữ tự nhiên.

Tin mới nhất

VNPT AI

Hãy trở thành đối tác của chúng tôi ngay hôm nay để được sử dụng những dịch vụ hàng đầu!

Gửi lời nhắnĐánh Giá

Các bài viết liên quan

.png)