LLM là gì? Khám phá ứng dụng và xu hướng của mô hình ngôn ngữ lớn

Large Language Model (LLM) – Mô hình ngôn ngữ lớn là một dạng trí tuệ nhân tạo (AI) được thiết kế để xử lý và tạo nội dung ngôn ngữ tự nhiên với độ chính xác cao. Được xây dựng dựa trên kiến trúc mạng nơ-ron sâu, đặc biệt là mô hình Transformer, LLM có khả năng học hỏi từ lượng dữ liệu khổng lồ.

Large Language Model - Mô hình ngôn ngữ lớn đang là tâm điểm của cuộc cách mạng trí tuệ nhân tạo, mở ra những tiềm năng đột phá trong nhiều lĩnh vực như xử lý ngôn ngữ tự nhiên, dịch thuật, và sáng tạo nội dung. Với khả năng phân tích và xử lý dữ liệu khổng lồ dựa trên cấu trúc tiên tiến như Transformer, LLM mang đến những lợi ích đột phá trong việc tạo nội dung, tự động hóa và hỗ trợ ra quyết định. Tuy nhiên, đi cùng tiềm năng ấy là những thách thức không nhỏ, từ yêu cầu tài nguyên tính toán khổng lồ đến việc kiểm soát độ chính xác và tính công bằng. Bài viết này của VNPT AI sẽ giúp bạn hiểu rõ llm là gì, từ cấu trúc cơ bản, nguyên lý hoạt động, đến các ứng dụng thực tiễn và xu hướng phát triển trong tương lai, đồng thời giới thiệu các mô hình nổi bật nhất hiện nay.

LLM là gì?

Large Language Model (LLM) - Mô hình ngôn ngữ lớn là một loại mô hình trí tuệ nhân tạo (AI) được phát triển để xử lý và tạo ngôn ngữ tự nhiên giống con người. Các LLM hoạt động dựa trên nền tảng học sâu (deep learning) và đặc biệt sử dụng kiến trúc mạng nơ-ron, thường là mô hình Transformer, để nắm bắt cấu trúc và ý nghĩa ngôn ngữ. Được huấn luyện trên lượng dữ liệu khổng lồ, bao gồm sách, bài báo, trang web, và nhiều nguồn tài nguyên ngôn ngữ khác, LLM không chỉ học cách xử lý các mẫu ngôn ngữ phức tạp mà còn nắm bắt được ngữ cảnh, ngữ nghĩa, và cả bối cảnh văn hóa trong nhiều ngôn ngữ khác nhau.

Về kỹ thuật, LLM hoạt động dựa trên nguyên lý "dự đoán từ tiếp theo" bằng cách sử dụng ngữ cảnh hiện có. Nhờ cơ chế Self-attention của mô hình Transformer, LLM xác định các phần quan trọng trong văn bản bất kể độ dài, giúp hiểu mối quan hệ giữa từ và cụm từ để tạo ra nội dung mạch lạc và phù hợp ngữ cảnh.

>>> Xem thêm: Deep Learning là gì? Ứng dụng và xu hướng tương lai của học sâu

Các thành phần cơ bản của LLM

Mô hình ngôn ngữ lớn là một thành tựu AI vượt bậc, được thiết kế để xử lý ngôn ngữ tự nhiên với độ chính xác cao, nhờ vào các yếu tố cốt lõi quan trọng:

- Mạng Nơ-ron Sâu (Deep Neural Network): Mạng nơ-ron sâu là nền tảng của LLM, gồm nhiều tầng nơ-ron liên kết, giúp mô hình xử lý dữ liệu lớn, nhận diện mẫu ngôn ngữ, ngữ pháp và ngữ nghĩa. Nhờ đó, mô hình tối ưu hóa phân tích và tạo ra ngôn ngữ tự nhiên giống con người.

- Dữ Liệu Huấn Luyện (Training Data): LLM cần lượng dữ liệu huấn luyện khổng lồ từ sách, bài báo, trang web và nghiên cứu. Nhờ hàng tỷ văn bản, mô hình học được ngôn ngữ và ngữ cảnh văn hóa, trở nên đa năng và linh hoạt trong nhiều ứng dụng.

- Thuật Toán Tối Ưu Hóa (Optimization Algorithm): Thuật toán tối ưu hóa, như gradient descent, là thành phần quan trọng trong LLM, giúp điều chỉnh hàng triệu hoặc tỷ tham số để tối ưu hiệu suất xử lý và dự đoán ngôn ngữ.

- Cơ Chế Attention: Cơ chế attention là yếu tố then chốt giúp LLM hiểu mối quan hệ giữa các từ trong câu, đặc biệt là với văn bản dài. Mô hình Transformer nổi bật nhờ khả năng tập trung vào các phần quan trọng của dữ liệu, cải thiện độ chính xác và hiệu quả xử lý, tạo ra phản hồi ngôn ngữ tự nhiên, mượt mà và logic.

Nguyên lý hoạt động của mô hình ngôn ngữ lớn

Nguyên lý hoạt động của Large Language Model xoay quanh khả năng dự đoán từ tiếp theo trong một câu dựa trên ngữ cảnh trước đó. Điều này được thực hiện thông qua các thành phần và kỹ thuật quan trọng sau:

Dự Đoán Từ Tiếp Theo (Next-Word Prediction)

LLM học cách dự đoán từ kế tiếp trong chuỗi văn bản bằng cách phân tích ngữ cảnh của các từ trước đó. Quá trình này giúp mô hình tạo ra câu văn mạch lạc, phản ánh ngữ pháp và ý nghĩa phù hợp. Ví dụ, trong câu "Hôm nay trời rất...", mô hình sẽ dự đoán "đẹp" hoặc "nóng" dựa trên dữ liệu học được.

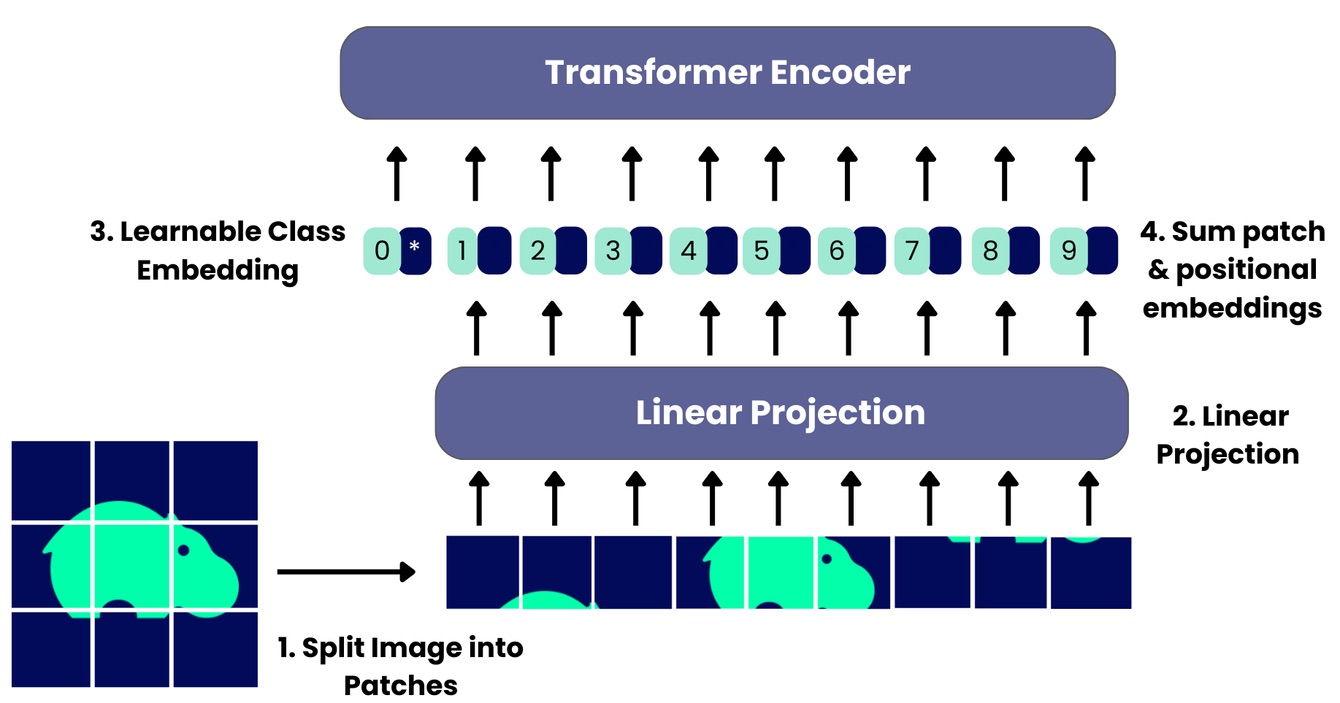

Mạng Nơ-ron Transformer

Transformer là kiến trúc mạng nơ-ron làm nền tảng cho LLM. Điểm mạnh của Transformer nằm ở khả năng xử lý các chuỗi dữ liệu dài và phức tạp, giúp mô hình nắm bắt mối quan hệ giữa các từ trong toàn bộ đoạn văn thay vì chỉ ở phạm vi gần.

Cơ chế Self-Attention

Cơ chế Self-attention cho phép mô hình tập trung vào các phần quan trọng của chuỗi dữ liệu khi xử lý ngôn ngữ. Thay vì coi trọng vị trí của từ, Self-attention đánh giá mối liên hệ giữa các từ bất kể chúng xuất hiện ở đâu trong câu, đặc biệt hữu ích trong việc xử lý các câu dài, phức tạp.

Học từ dữ liệu lớn

LLM được huấn luyện trên lượng dữ liệu khổng lồ, bao gồm hàng tỷ câu văn từ nhiều nguồn khác nhau. Trong quá trình này, mô hình liên tục điều chỉnh các tham số thông qua thuật toán tối ưu hóa để cải thiện độ chính xác và khả năng dự đoán.

>>> Có thể bạn quan tâm: Big data là gì? Ứng dụng và xu hướng nổi bật của dữ liệu lớn

Ưu nhược điểm của LLM

Mô hình ngôn ngữ lớn là một công nghệ vượt trội trong xử lý ngôn ngữ tự nhiên, mang lại khả năng sáng tạo nội dung và tự động hóa nhiều nhiệm vụ hiệu quả. Tuy vậy, như bất kỳ công nghệ nào, Large Language Model cũng có những điểm hạn chế cần xem xét để sử dụng một cách tối ưu.

Ưu điểm

- Hiểu và tạo ngôn ngữ tự nhiên: LLM có khả năng hiểu và tạo ra văn bản với chất lượng gần giống con người, từ việc trả lời câu hỏi, tạo nội dung, đến dịch thuật.

- Xử lý dữ liệu quy mô lớn: Mô hình có thể phân tích và học từ hàng tỉ từ, giúp chúng nắm bắt các mẫu ngôn ngữ phức tạp và thực hiện các tác vụ đa dạng.

- Khả năng tạo nội dung sáng tạo: Các mô hình này có thể tạo ra văn bản mới, sáng tạo và phù hợp với ngữ cảnh yêu cầu, từ viết bài đến viết kịch bản.

- Tự động hóa nhiều tác vụ: LLM có thể hỗ trợ tự động hóa các công việc như viết báo cáo, tổng hợp thông tin, hỗ trợ khách hàng, giúp tiết kiệm thời gian và tăng năng suất.

Nhược điểm

- Cần tài nguyên tính toán lớn: Việc huấn luyện và vận hành LLM đòi hỏi phần cứng mạnh mẽ và tốn kém, đặc biệt là trong môi trường sản xuất.

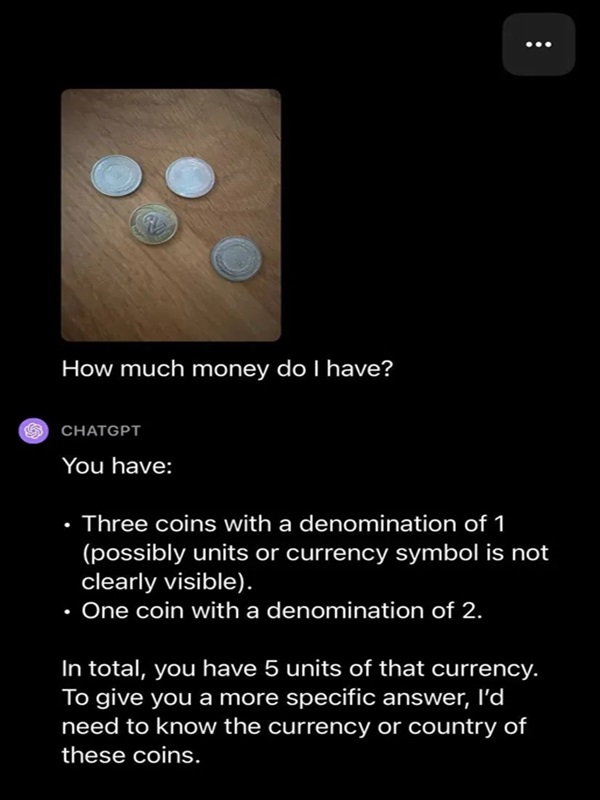

- Khả năng sai sót và thiếu chính xác: Mặc dù mô hình có thể tạo ra văn bản tự nhiên, nhưng chúng đôi khi vẫn mắc phải lỗi, như việc tạo ra thông tin sai lệch hoặc không hợp lý.

- Thiếu hiểu biết sâu sắc: Large Language Model không thực sự "hiểu" ngữ nghĩa như con người, mà chỉ dựa vào các mẫu học được từ dữ liệu huấn luyện.

- Vấn đề về đạo đức và thiên vị: LLM có thể bị ảnh hưởng bởi các thiên vị có sẵn trong dữ liệu huấn luyện, dẫn đến việc tạo ra nội dung thiếu công bằng hoặc phản ánh quan điểm sai lệch.

Một số ứng dụng của LLM hiện nay

Nhờ vào khả năng phân tích ngôn ngữ tự nhiên và học hỏi từ lượng dữ liệu khổng lồ, LLM đang trở thành một công cụ không thể thiếu trong nhiều lĩnh vực, từ kinh doanh đến giáo dục và y tế:

Trong lĩnh vực Marketing và Truyền thông quảng cáo

- Sáng tạo nội dung: Các mô hình ngôn ngữ lớn hỗ trợ tạo nội dung chất lượng cao cho nhiều định dạng và cung cấp chức năng chỉnh sửa, cải thiện ngữ pháp, phong cách, cùng khả năng tóm tắt chính xác. Chúng giúp người sáng tạo phát triển ý tưởng mới, đáp ứng tốt hơn nhu cầu khán giả mục tiêu.

- Marketing cá nhân hóa: Large Language Model cho phép cá nhân hóa nội dung marketing, từ email đến mạng xã hội và quảng cáo. Bằng cách phân tích dữ liệu người dùng, chúng đề xuất chiến dịch tối ưu, giúp doanh nghiệp nhắm đúng đối tượng, tăng tương tác và hiệu quả tiếp cận, đồng thời đảm bảo nội dung phù hợp với từng cá nhân.

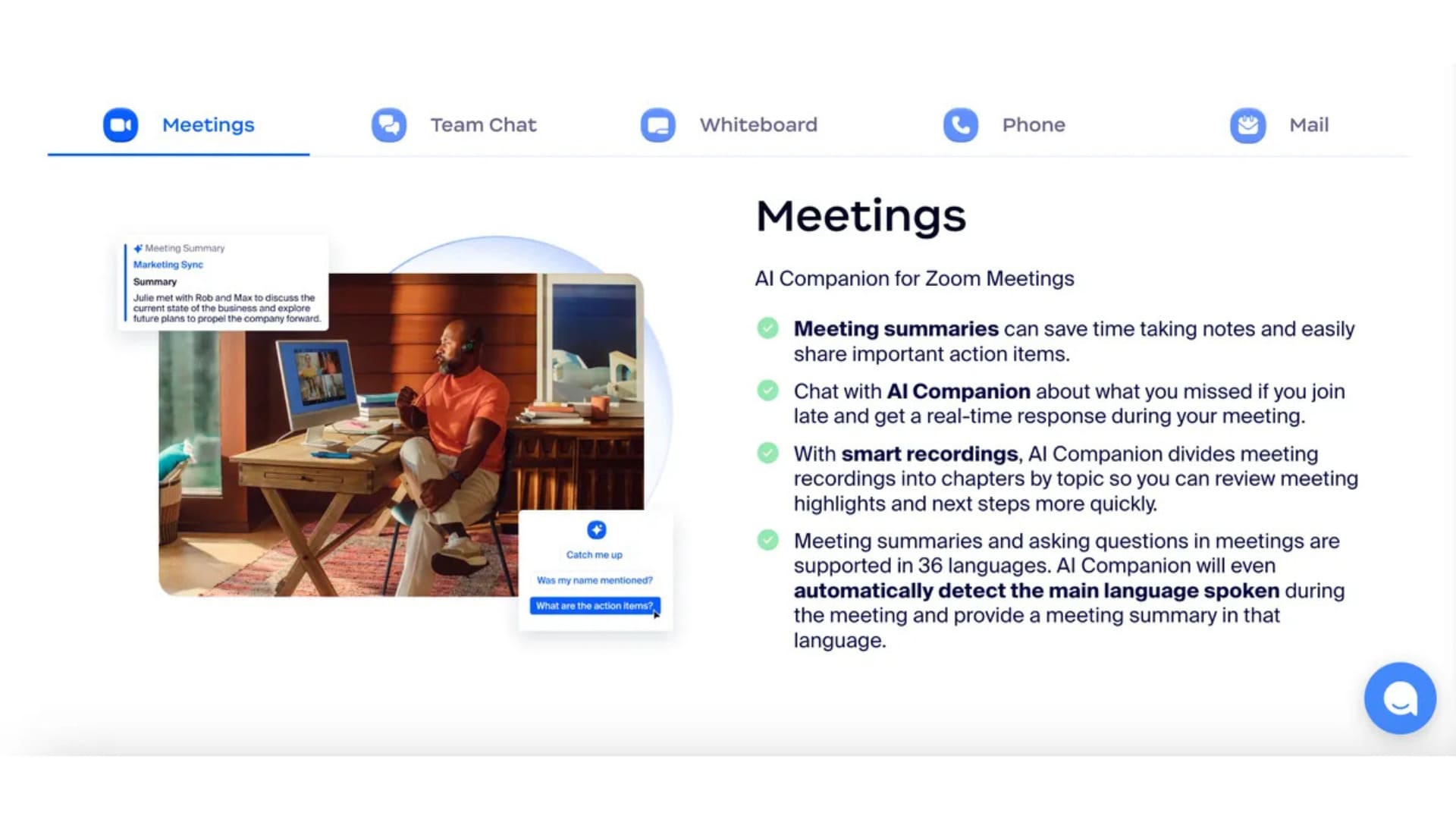

- Chatbot thông minh: Chatbot tích hợp LLM cung cấp hỗ trợ khách hàng 24/7, xử lý hiệu quả các yêu cầu và thu thập dữ liệu tương tác. Điều này giúp đội ngũ bán hàng hiểu rõ khách hàng hơn và tối ưu hóa cơ hội kinh doanh từ mọi tương tác.

- Phân tích tâm trạng: LLM phân tích tâm trạng khách hàng qua dữ liệu mạng xã hội, nhận biết cảm xúc và các sắc thái phức tạp như mỉa mai. Điều này giúp doanh nghiệp đánh giá chiến dịch, quản lý danh tiếng và nâng cao sự hài lòng của khách hàng.

Trong lĩnh vực Bán lẻ và Thương mại điện tử

- Gợi ý cá nhân hóa: Mô hình ngôn ngữ lớn sử dụng dữ liệu như lịch sử mua sắm và duyệt web để nhận diện xu hướng và cung cấp gợi ý sản phẩm, dịch vụ cá nhân hóa tối ưu. Khác với công cụ tìm kiếm truyền thống, LLM xử lý truy vấn phức tạp và đưa ra kết quả chính xác hơn, nâng cao trải nghiệm mua sắm trực tuyến. Tích hợp trong nền tảng sáng tạo, Large Language Model biến trải nghiệm duyệt web mạnh mẽ và cá nhân hóa, tạo nên cuộc cách mạng trong hành vi mua sắm, tăng sự hài lòng và gắn kết người dùng.

- Bản địa hóa toàn diện: LLM đóng vai trò quan trọng trong việc bản địa hóa phần mềm và trang web, giúp doanh nghiệp tối ưu nội dung cho thị trường quốc tế. Với khả năng dịch thuật chính xác và phù hợp văn hóa, mô hình ngôn ngữ lớn đảm bảo giao diện thân thiện, hỗ trợ doanh nghiệp vượt qua rào cản ngôn ngữ, mở rộng quy mô và mang lại trải nghiệm đồng nhất cho khách hàng toàn cầu.

Trong lĩnh vực Giáo dục

- Cá nhân hóa giáo dục: Mô hình ngôn ngữ lớn hỗ trợ tạo ra các gia sư hoặc giáo viên ảo, giúp học sinh đặt câu hỏi và nhận được hỗ trợ tức thời mà không cần sự hiện diện của người hướng dẫn thực tế. Bên cạnh đó, LLM giúp giáo viên điều chỉnh bài giảng phù hợp với nhu cầu, phong cách, và tốc độ học của từng học sinh. Phương pháp này thay thế cách tiếp cận truyền thống, mang lại trải nghiệm học tập hiệu quả, hấp dẫn và thúc đẩy đam mê học hỏi.

- Theo dõi hiệu suất theo thời gian thực: Bằng cách phân tích dữ liệu học tập ngay lập tức, Large Language Model cung cấp cho giáo viên cái nhìn chi tiết về những khó khăn mà học sinh gặp phải. Điều này cho phép giáo viên điều chỉnh phương pháp giảng dạy kịp thời, đảm bảo việc bổ sung kiến thức bị hổng và cải thiện hiệu suất học tập tổng thể.

- Chấm điểm và phản hồi tự động: LLM tích hợp công cụ tự động giúp giảm tải công việc cho giáo viên bằng cách cung cấp phản hồi tức thời cho học sinh. Điều này không chỉ nâng cao trải nghiệm học tập mà còn khuyến khích tinh thần tự học và trách nhiệm cá nhân. Khả năng nhận phản hồi nhanh chóng giúp học sinh cải thiện hiệu quả, phát triển kỹ năng tự học, và chuẩn bị tốt hơn cho thị trường lao động hiện đại.

Trong lĩnh vực Y tế

- Chẩn đoán y học: Giao tiếp hiệu quả là yếu tố quan trọng trong y tế, nơi bệnh nhân cần tư vấn và hỗ trợ kịp thời. LLM đóng vai trò nền tảng cho các chatbot thông minh, giúp hiểu và trả lời câu hỏi của bệnh nhân một cách chính xác và tự nhiên. Các chatbot này không chỉ giải đáp thắc mắc, cung cấp thông tin về tình trạng sức khỏe và hướng dẫn sử dụng thuốc mà còn giải quyết lo ngại của bệnh nhân, tăng cường niềm tin và giúp bệnh nhân đưa ra quyết định sáng suốt về sức khỏe.

- Tăng cường hồ sơ y tế điện tử (EHR): Hồ sơ y tế điện tử (EHR) ngày càng phổ biến, với lượng dữ liệu y tế gia tăng. LLM hỗ trợ phân tích ghi chú lâm sàng và trích xuất thông tin giá trị từ các ca bệnh, giúp tổ chức và phân loại dữ liệu hiệu quả. Điều này giúp chuyên gia y tế nhận diện dấu hiệu bất thường, giảm sai sót và đưa ra chẩn đoán chính xác hơn, cải thiện chất lượng chăm sóc bệnh nhân và tối ưu hóa quá trình ra quyết định của đội ngũ y tế.

Trong lĩnh vực Tài chính

- Hướng dẫn tài chính cá nhân hóa: Large Language Model giúp các công ty tài chính cung cấp hướng dẫn tài chính cá nhân hóa, từ lập kế hoạch đầu tư đến chuẩn bị hưu trí. Tư vấn viên hỗ trợ bởi LLM có thể đưa ra lời khuyên phù hợp với mục tiêu và hoàn cảnh của từng khách hàng, nâng cao sự hài lòng và củng cố mối quan hệ giữa khách hàng và tổ chức tài chính, đồng thời giúp khách hàng tự tin hơn trong việc điều hướng thế giới tài chính phức tạp.

- Phát hiện gian lận: LLM đóng vai trò quan trọng trong phát hiện gian lận, như đánh cắp danh tính hoặc gian lận thẻ tín dụng. Nhờ khả năng phân tích dữ liệu thời gian thực, LLM nhanh chóng nhận diện các giao dịch bất thường, kích hoạt cảnh báo và điều tra kịp thời để ngăn chặn rủi ro. Ngoài ra, LLM còn đánh giá điểm rủi ro cho giao dịch và tài khoản, giúp đảm bảo an ninh tài chính và giảm thiểu tổn thất.

- Hỗ trợ tuân thủ quy định: Mô hình ngôn ngữ lớn giúp các tổ chức tài chính tuân thủ quy định bằng cách cung cấp thông tin nhanh chóng và cập nhật về thay đổi pháp lý. Chúng hỗ trợ tài liệu và giải đáp thắc mắc, giúp ngân hàng đáp ứng yêu cầu pháp lý, giảm rủi ro bị phạt và bảo vệ uy tín. Đồng thời, LLM thúc đẩy minh bạch, củng cố niềm tin giữa tổ chức tài chính và các bên liên quan, góp phần xây dựng ngành ngân hàng an toàn và tin cậy.

Cách huấn luyện các mô hình ngôn ngữ lớn phổ biến

Huấn luyện một mô hình ngôn ngữ lớn là quá trình phức tạp, đòi hỏi sự kết hợp chặt chẽ giữa dữ liệu chất lượng cao, kiến trúc mạng tiên tiến, và tài nguyên tính toán mạnh mẽ. Dưới đây là các bước cơ bản để xây dựng một LLM hiệu quả:

Bước 1: Thu thập dữ liệu huấn luyện

Dữ liệu là yếu tố nền tảng để huấn luyện các LLM. Nguồn dữ liệu thường đến từ sách, bài báo, trang web, mạng xã hội, và tài liệu chuyên ngành. Dữ liệu thô sẽ được làm sạch và chuẩn hóa thông qua các kỹ thuật xử lý ngôn ngữ tự nhiên (NLP) để đảm bảo tính chính xác và chất lượng.

Bước 2: Thiết kế kiến trúc mô hình

Phần lớn các LLM hiện nay sử dụng kiến trúc Transformer với cơ chế attention, đặc biệt là self-attention, giúp hiểu mối quan hệ ngữ cảnh giữa các từ. Các siêu tham số như số lớp mạng, kích thước embedding, và số lượng attention heads được tinh chỉnh để tối ưu hóa hiệu suất của mô hình.

Bước 3: Huấn luyện bằng học sâu (Deep learning)

Quá trình huấn luyện sử dụng thuật toán học tiến hóa (Gradient Descent) để điều chỉnh trọng số trong mạng nơ-ron. Các thuật toán tối ưu hóa như Adam hoặc SGD được áp dụng để giảm thiểu hàm mất mát (loss function), giúp mô hình ngôn ngữ lớn dự đoán chính xác từ hoặc câu tiếp theo.

Bước 4: Sử dụng hệ thống máy tính hiệu năng cao

LLM yêu cầu phần cứng mạnh mẽ như GPU hoặc TPU để xử lý hàng tỷ tham số. Để tăng tốc quá trình, mô hình thường được huấn luyện trên các cụm máy tính với dữ liệu được phân tán đều giữa các máy.

Bước 5: Kỹ thuật Fine-tuning

Sau giai đoạn huấn luyện sơ bộ với tập dữ liệu lớn, mô hình được tinh chỉnh (fine-tuned) trên tập dữ liệu chuyên biệt để phù hợp với các nhiệm vụ cụ thể như phân loại văn bản, tóm tắt nội dung, hoặc tạo văn bản.

Bước 6: Đánh giá và kiểm tra

Hiệu suất của LLM được kiểm tra bằng cách so sánh đầu ra với tập dữ liệu kiểm tra. Các chỉ số như BLEU, ROUGE hoặc perplexity được sử dụng để đánh giá chất lượng ngôn ngữ mà mô hình tạo ra.

Bước 7: Triển khai và cập nhật

Sau khi huấn luyện, mô hình được triển khai vào các ứng dụng như chatbot, trợ lý ảo, hoặc công cụ tìm kiếm. Để duy trì hiệu năng, LLM thường xuyên được cập nhật và huấn luyện lại với dữ liệu mới.

TOP 5 mô hình ngôn ngữ lớn nổi bật hiện nay

Các mô hình ngôn ngữ lớn (LLM) đã trở thành nền tảng quan trọng trong việc xử lý ngôn ngữ tự nhiên, mang lại khả năng ứng dụng vượt trội trong nhiều lĩnh vực từ viết nội dung, chăm sóc khách hàng đến nghiên cứu khoa học. Những mô hình này không chỉ thể hiện sự tiến bộ vượt bậc về công nghệ mà còn mở ra nhiều cơ hội sáng tạo và cải tiến cho doanh nghiệp và người dùng. Dưới đây là 5 mô hình ngôn ngữ lớn nổi bật hiện nay

GPT

OpenAI vừa ra mắt mô hình AI mới là ChatGPT o3 và phiên bản thu gọn ChatGPT o3-mini, tập trung vào cải thiện khả năng lập luận và giải quyết các vấn đề logic phức tạp. Theo OpenAI, o3 đã đạt điểm số cao hơn đáng kể so với các mô hình trước đó trong các bài kiểm tra về mã hóa phức tạp và toán học nâng cao. Trong khi đó ChatGPT o3-mini là một phiên bản nhỏ gọn và hiệu quả hơn của o3, được tối ưu hóa cho các tác vụ liên quan đến khoa học, toán học và lập trình. Mô hình này cung cấp các tính năng như gọi hàm, đầu ra có cấu trúc và hỗ trợ cho các nhà phát triển, đồng thời duy trì chi phí thấp và giảm độ trễ.

Ngoài ra, OpenAI đã ra mắt công cụ "deep research", một AI mới có khả năng tạo ra các báo cáo toàn diện trong khoảng thời gian từ 5 đến 30 phút. Công cụ này phân tích và tổng hợp dữ liệu từ nhiều nguồn trực tuyến, hỗ trợ các chuyên gia trong các lĩnh vực như tài chính, khoa học và kỹ thuật…

Gemini

Gemini là dòng mô hình LLM độc quyền của Google, bao gồm các phiên bản như Gemini 1.0 Nano, Gemini 1.5 Flash, Gemini 1.5 Pro và Gemini 1.0 Ultra, với 1,5 nghìn tỷ tham số, phù hợp cho nhiều nền tảng từ điện thoại đến máy chủ. Tuy nhiên, vì là mô hình mã nguồn đóng, các doanh nghiệp cần lưu ý về bảo mật và tuân thủ các tiêu chuẩn bảo vệ dữ liệu như GDPR hoặc HIPAA khi sử dụng.

Một lựa chọn thay thế mở và tiết kiệm hơn là Gemma 2 của Google, với các mô hình 2, 9 và 27 tỷ tham số, cung cấp hiệu suất mạnh mẽ và thích hợp cho các doanh nghiệp cần tiết kiệm chi phí.

LLaMA

LlaMA 3.2, ra mắt vào tháng 9/2024, là mô hình AI tiên tiến của Meta với khả năng xử lý văn bản và hình ảnh, giúp phân tích sâu và tạo phản hồi chính xác, như diễn giải biểu đồ hoặc dịch văn bản trong ảnh. Với các phiên bản 8, 70, và 405 tỷ tham số cùng cửa sổ ngữ cảnh 128.000 token, LlaMA 3.2 đáp ứng tốt các nhu cầu xử lý dữ liệu lớn. Là mô hình mã nguồn mở, LlaMA cho phép doanh nghiệp tự do triển khai, tùy chỉnh và tích hợp vào hệ thống hiện có, lý tưởng cho các lĩnh vực như dịch vụ khách hàng, giáo dục và marketing.

QWen

QwQ-32B-Preview, mô hình nghiên cứu mới nhất của Alibaba, đã gây chú ý trong cộng đồng AI. Được phát triển bởi Nhóm Qwen, mô hình này tập trung vào nâng cao khả năng suy luận của AI với 32,5 tỷ tham số, vượt trội trong các lĩnh vực như lập trình, tính toán toán học, và suy luận logic. Thậm chí, QwQ-32B đạt kết quả cao hơn GPT-4 và o1-preview trong các bài kiểm tra chuyên sâu.

Hiện tại, mô hình này có thể thử nghiệm trên nền tảng Hugging Face, với điểm nổi bật là khả năng tự kiểm tra và lập kế hoạch, phù hợp cho các doanh nghiệp cần xử lý dữ liệu lớn. Nếu tìm kiếm giải pháp mã nguồn mở, Qwen 2.5 (với 0,5–72 tỷ tham số và cửa sổ ngữ cảnh 128.000 token) là lựa chọn thay thế mạnh mẽ, lý tưởng cho lập trình, gỡ lỗi, và dự báo tự động.

Mistral

Mistral Large 2, mô hình mới nhất từ Mistral, nổi bật với hiệu suất tính toán, hỗ trợ lập trình, và các tính năng an toàn. Với 123 tỷ tham số và cửa sổ ngữ cảnh 128.000 token, mô hình này duy trì tính mạch lạc trên các đoạn văn bản dài, lý tưởng cho các ứng dụng xử lý tài liệu phức tạp.

Dù không hoàn toàn mã nguồn mở, Mistral Large 2 vẫn dễ dàng truy cập trên các nền tảng như Hugging Face, cho phép doanh nghiệp triển khai trong môi trường riêng. Tuy nhiên, việc tinh chỉnh và tùy chỉnh mô hình này có thể khó khăn hơn so với các mô hình mã nguồn mở.

Xu hướng của Large language model trong tương lai

Large Language Models (LLM) đang định hình tương lai của trí tuệ nhân tạo (AI) thông qua những bước tiến vượt bậc về hiệu suất và khả năng ứng dụng. Trong tương lai, các LLM sẽ tiếp tục phát triển theo 5 xu hướng chính sau:

Tối ưu hóa mô hình và hiệu suất

LLM hiện nay tiêu tốn nhiều tài nguyên để huấn luyện và vận hành. Trong tương lai, chúng sẽ tập trung tối ưu hóa hiệu suất và giảm chi phí tính toán mà vẫn duy trì độ chính xác. Các giải pháp như pruning, quantization và distillation sẽ giảm kích thước mô hình mà không ảnh hưởng đến hiệu suất, giúp tiết kiệm tài nguyên và mở rộng khả năng triển khai. Ngoài ra, LLM sẽ được tối ưu hóa để hoạt động trên các thiết bị nhỏ như điện thoại và IoT, giúp người dùng dễ dàng tiếp cận AI và tích hợp vào cuộc sống hàng ngày.

Tích hợp đa phương thức

Trong tương lai, LLM sẽ mở rộng khả năng xử lý các loại dữ liệu như hình ảnh, âm thanh và video, mang lại khả năng tương tác toàn diện. Sự kết hợp giữa mô hình ngôn ngữ và các loại dữ liệu này tạo ra ứng dụng mới, giúp AI phản hồi không chỉ dựa trên văn bản mà còn trên các hình thức dữ liệu khác. Các mô hình như GPT-4 Vision và Gemini đã chứng minh tiềm năng của việc kết hợp phân tích ngôn ngữ với nhận diện hình ảnh và video, mang đến trải nghiệm người dùng phong phú hơn, giúp AI hiểu và phân tích văn bản, hình ảnh, âm thanh trong ngữ cảnh rộng hơn.

Ứng dụng tùy chỉnh theo ngành

Các mô hình AI chuyên biệt sẽ hỗ trợ chẩn đoán y khoa, đánh giá rủi ro tài chính và thiết kế nội dung giáo dục, giúp chuyên gia làm việc nhanh chóng và chính xác hơn. Ví dụ, trong y tế, LLM giúp bác sĩ phân tích dữ liệu bệnh lý và đưa ra gợi ý chẩn đoán, trong tài chính hỗ trợ phân tích thị trường và đánh giá rủi ro. Khi huấn luyện cho ngành nghề cụ thể, LLM sẽ tăng độ chính xác và giảm sai sót, đặc biệt quan trọng trong các lĩnh vực yêu cầu tính chính xác cao như pháp lý và y tế.

Tăng cường suy luận và giải quyết vấn đề

Trong tương lai, Large Language Model sẽ không chỉ tạo nội dung ngôn ngữ mà còn phát triển khả năng suy luận logic, phân tích phức tạp và giải quyết vấn đề. Công nghệ học tăng cường, đặc biệt là RLHF (Reinforcement Learning with Human Feedback), sẽ giúp mô hình đưa ra quyết định thông minh hơn qua phản hồi người dùng. LLM cũng sẽ hỗ trợ nghiên cứu khoa học bằng cách phân tích dữ liệu lớn và đề xuất hướng đi mới, góp phần giải quyết các vấn đề khoa học phức tạp, thúc đẩy tiến bộ trong các lĩnh vực như y tế và vật lý.

Tính bền vững và đạo đức

Với sự phát triển của AI, các nhà nghiên cứu đang nỗ lực giảm thiểu tác động môi trường và đảm bảo tính đạo đức trong việc sử dụng LLM. Công nghệ huấn luyện phân tán và năng lượng tái tạo sẽ giảm phát thải carbon từ các mô hình AI, góp phần bảo vệ môi trường. Đồng thời, đảm bảo tính minh bạch và công bằng trong dữ liệu và mô hình, tránh thiên kiến, là xu hướng quan trọng để tăng cường sự tin cậy và công bằng trong triển khai LLM.

Lời kết

Qua bài viết LLM là gì? VNPT AI hy vọng bạn đã thêm kiến thức cơ bản về định nghĩa, nguyên lý hoạt động của mô hình ngôn ngữ lớn. Tương lai của các mô hình ngôn ngữ lớn mang đến cơ hội và thách thức, với khả năng mở rộng sang các lĩnh vực như hình ảnh, âm thanh và video, tạo ra trải nghiệm tương tác phong phú. Tuy nhiên, tối ưu hóa hiệu suất, giảm tác động môi trường và đảm bảo tính đạo đức sẽ quyết định sự thành công lâu dài của LLM, giúp thay đổi cách chúng ta làm việc, học tập và giải quyết vấn đề.

VNPT AI, với kinh nghiệm vững chắc trong lĩnh vực trí tuệ nhân tạo tại Việt Nam, đã nhận ra tiềm năng của Large Language Model và ứng dụng công nghệ này trong các sản phẩm của mình. Một ví dụ điển hình là VNPT Smartbot, nền tảng hỗ trợ Chatbot, Voicebot, Callbot và Trợ lý ảo AI. Điều này chứng tỏ LLM có ứng dụng thực tiễn lớn và tiềm năng phát triển mạnh mẽ trong tương lai.

Bài viết đã được tham vấn bởi: Nguyễn Tiến Cường (Carlo Nguyen)

Tin mới nhất

VNPT AI

Hãy trở thành đối tác của chúng tôi ngay hôm nay để được sử dụng những dịch vụ hàng đầu!

Gửi lời nhắnĐánh Giá

Các bài viết liên quan

.jpg)