LoRA là gì? Ưu điểm và tính ứng dụng của công nghệ LoRA trong thực tế

LoRA là một bước tiến đột phá giúp "dân chủ hóa AI". Thay vì chỉ có các doanh nghiệp hay tập đoàn lớn có đủ khả năng fine-tune LLM, thì nay các tổ chức, doanh nghiệp nhỏ, start up hay cá nhân cũng có thể huấn luyện mô hình riêng của mình với chi phí thấp.

Trong bối cảnh các mô hình trí tuệ nhân tạo ngày càng phức tạp, LoRA xuất hiện như một giải pháp tối ưu giúp quá trình tinh chỉnh nhanh chóng, tiết kiệm bộ nhớ mà vẫn duy trì hiệu suất cao. Vậy LoRA là gì, hoạt động như thế nào và đang được ứng dụng ra sao trong thực tiễn? Bài viết sau đây của VNPT AI sẽ giúp bạn hiểu rõ hơn về công nghệ đang định hình cách thức vận hành của trí tuệ nhân tạo hiện đại.

LoRA là gì?

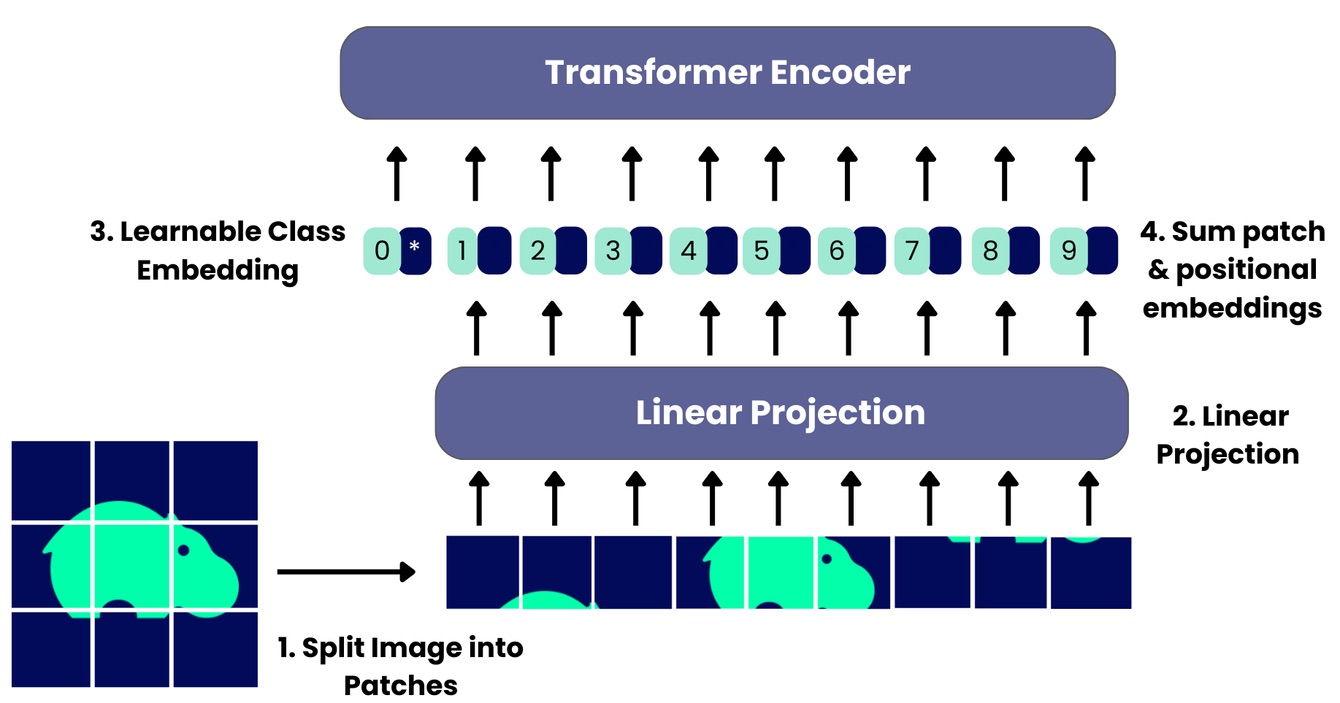

LoRA (viết tắt của Low-Rank Adaptation) là một kỹ thuật tinh chỉnh mô hình ngôn ngữ lớn (Large Language Model - LLM) theo cách tối ưu hơn, với khả năng tiết kiệm tài nguyên và dung lượng lưu trữ. Thay vì thay đổi toàn bộ kiến trúc, LoRA chỉ bổ sung một số trọng số mới vào mô hình gốc và huấn luyện riêng phần này. Nhờ vậy, quá trình huấn luyện trở nên nhanh hơn, ít tốn bộ nhớ hơn, nhưng vẫn đảm bảo hiệu suất cao, đặc biệt trong các tác vụ cần tùy biến theo ngữ cảnh.

>>> Tìm hiểu thêm: Fine-tuning là gì?

Cơ chế hoạt động của LoRA

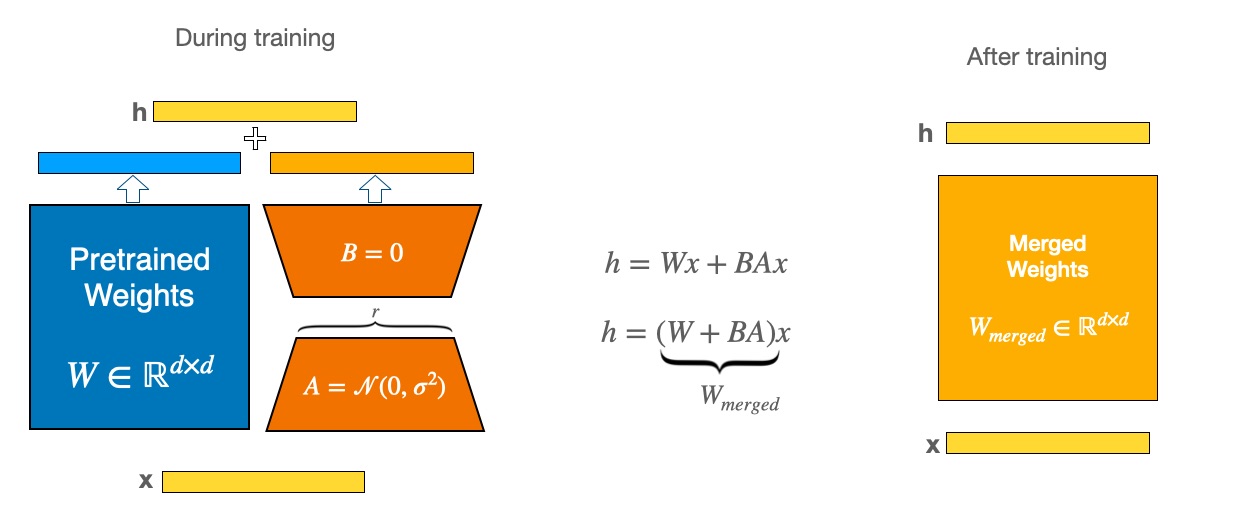

Thay vì huấn luyện lại toàn bộ mô hình, LoRA giữ nguyên trọng số gốc và chỉ thêm vào các ma trận hạng thấp (low-rank matrices) - những phần nhỏ, dễ tinh chỉnh trong từng lớp của mô hình. Cách làm này giúp giảm đáng kể số tham số cần huấn luyện, đồng thời tiết kiệm bộ nhớ GPU.

Với cơ chế low rank adaptation, các ma trận cập nhật sẽ được cộng thêm vào với trọng số ban đầu để tạo ra phiên bản mô hình tinh chỉnh cuối cùng, linh hoạt và hiệu quả hơn, phục vụ toàn diện cho các ngữ cảnh sử dụng cụ thể.

Ví dụ: Một ma trận bậc cao 4x4 (ma trận có 16 giá trị) có thể được phân tách thành 2 ma trận bậc thấp với số giá trị nhiều hơn, ví dụ như: 1x4 và 4x1. Khi nhân hai ma trận nhỏ này lại với nhau, ta sẽ thu được một ma trận 4x4 gần giống với ma trận ban đầu.

Ưu điểm của công nghệ LoRA

LoRA sở hữu nhiều ưu điểm vượt trội so với các công nghệ trước đó. Cụ thể như:

- Tối ưu chi phí và tài nguyên: Thay vì tinh chỉnh toàn bộ mô hình, công nghệ LoRA chỉ cập nhật các ma trận hạng thấp, giúp giảm đáng kể số tham số cần huấn luyện, cho phép tinh chỉnh mô hình lớn ngay cả khi phần cứng hạn chế.

- Giữ nguyên chất lượng mô hình: Mặc dù giảm lượng tham số huấn luyện, LoRA vẫn đảm bảo chất lượng đầu ra và tốc độ suy luận của mô hình, không bị ảnh hưởng về mặt chất lượng.

- Giảm dung lượng tệp lưu trạng thái mô hình (checkpoint): So với các phương pháp truyền thống, LoRA cho phép giảm mạnh kích thước mô hình sau tinh chỉnh. Ví dụ: Khi tinh chỉnh GPT-3, kích thước tệp checkpoint có thể giảm từ 1TB xuống chỉ còn 25MB, giúp bạn có thể dễ dàng lưu trữ và chia sẻ.

- Giảm độ trễ trong suy luận: Trong giai đoạn triển khai, các ma trận hạng thấp được gộp lại với trọng số gốc của mô hình, đảm bảo không làm chậm tốc độ phản hồi.

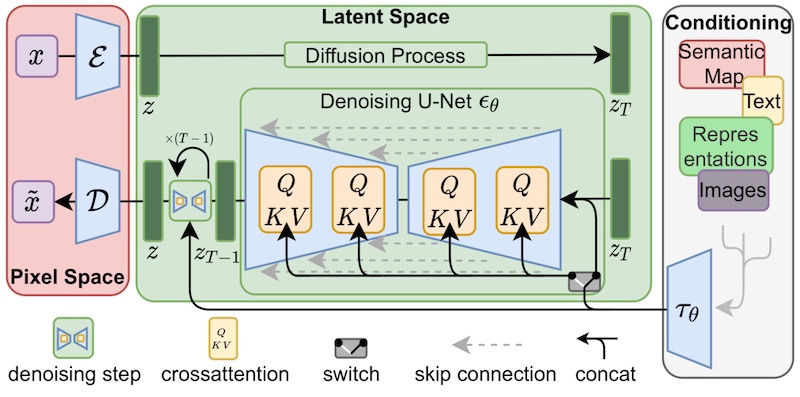

- Linh hoạt và dễ áp dụng: Công nghệ LoRA có thể tích hợp vào hầu hết các mô hình dùng phép nhân ma trận, từ mô hình ngôn ngữ đến mô hình hình ảnh như Stable Diffusion. Đồng thời, LoRA còn có thể kết hợp với các kỹ thuật khác như prefix-tuning (tinh chỉnh hiệu quả tham số) để tăng hiệu quả.

- Thay đổi mô hình nhanh chóng: Chỉ cần thay thế ma trận LoRA để chuyển đổi tác vụ, người dùng không phải huấn luyện lại mô hình gốc, từ đó tiết kiệm đáng kể thời gian và tài nguyên.

Ứng dụng thực tế của LoRA

LoRA mang lại nhiều tiện ích trong đời sống, thể hiện rõ qua hai khía cạnh chính:

Tùy biến mô hình ngôn ngữ lớn Large Language Models (LLMs)

Các mô hình ngôn ngữ lớn như GPT-3 hay LLaMA có tới hàng trăm tỷ tham số. Thay vì phải huấn luyện lại toàn bộ, công nghệ LoRA chỉ cho phép tinh chỉnh với vài triệu tham số. Nhờ đó, có thể chuyên biệt hóa mô hình cho các lĩnh vực cụ thể như:

- Y tế: Tinh chỉnh LLMs để hỗ trợ chẩn đoán sơ bộ dựa trên hồ sơ bệnh án, tài liệu nghiên cứu y khoa, ghi chú của bác sĩ và các hướng dẫn lâm sàng. Ngoài ra, LLMs được tinh chỉnh bằng LoRA có thể hỗ trợ bác sĩ bằng cách tóm tắt nhanh các bài báo nghiên cứu y học phức tạp, giải thích các thuật ngữ y tế bằng ngôn từ dễ hiểu cho bệnh nhân,...

- Pháp luật: Tinh chỉnh LLMs bằng LoRA trên một tập dữ liệu khổng lồ các bộ luật, án lệ, văn bản quy phạm pháp luật, hợp đồng mẫu,.... để hỗ trợ nghiên cứu pháp lý, tóm tắt các điều khoản hợp đồng, tìm kiếm và trích xuất thông tin liên quan, so sánh các điều luật,.....

- Chatbot: Tinh chỉnh LLM cho chatbot hỗ trợ khách hàng dựa trên các tài liệu hướng dẫn sử dụng sản phẩm, câu hỏi thường gặp (FAQs), chính sách bảo hành và điều khoản doanh nghiệp,..... Từ đó hỗ trợ chatbot đưa ra phản hồi thông minh và tự nhiên hơn trong từng ngữ cảnh dịch vụ, trả lời đúng các thắc mắc của khách hàng.

Tối ưu đầu ra mô hình tạo ảnh (Stable Diffusion & AI Art)

LoRA được ứng dụng rộng rãi để mở rộng khả năng sáng tạo và tùy biến đầu ra của các mô hình tạo hình ảnh:

- Tạo hình ảnh với phong cách nghệ thuật: Huấn luyện mô hình sản xuất ảnh theo phong cách cá nhân hóa, hoặc kết hợp nhiều mô-đun LoRA để tạo ra tác phẩm mang dấu ấn riêng: anime, tranh sơn dầu,.....

- Tạo nhân vật hoặc đối tượng nhất quán: Người dùng có thể tạo nhân vật hoạt hình nhất quán qua nhiều bối cảnh, hay huấn luyện mô hình để tạo vật thể, cảnh quan chuyên biệt.

- Thêm chi tiết cụ thể vào hình ảnh: Huấn luyện một adapter LoRA trên một tập dữ liệu các hình ảnh của một phong cách kiến trúc đặc biệt hoặc loại trang phục cụ thể. Khi sử dụng adapter này, bạn có thể thêm chi tiết kiến trúc hoặc trang phục đó vào hình ảnh bạn tạo ra.

Tạm kết:

Hy vọng những thông tin được VNPT AI chia sẻ trên đây đã giúp bạn hiểu rõ LoRA là gì và lý do công nghệ này ngày càng được ứng dụng rộng rãi. Đây không chỉ là một kỹ thuật tinh chỉnh đơn thuần mà còn là một bước tiến quan trọng, hỗ trợ không nhỏ cho việc phát triển và ứng dụng trí tuệ nhân tạo, đặc biệt trong các tác vụ như tùy biến mô hình ngôn ngữ lớn, tối ưu đầu ra mô hình tạo ảnh.

Tin mới nhất

VNPT AI

Hãy trở thành đối tác của chúng tôi ngay hôm nay để được sử dụng những dịch vụ hàng đầu!

Gửi lời nhắnĐánh Giá