Convolutional Neural Networks là gì? Khám phá cấu trúc của CNN

CNN hoạt động dựa trên nguyên lý của mạng nơ-ron truyền thống, nhưng điểm khác biệt chính là khả năng tự động trích xuất đặc trưng mà không cần sự can thiệp thủ công từ con người.

Trong thời đại trí tuệ nhân tạo (AI) bùng nổ, khả năng nhận diện hình ảnh và xử lý dữ liệu thị giác đã trở thành nền tảng của nhiều công nghệ đột phá. Từ xe tự lái, nhận diện khuôn mặt đến phân tích y tế, tất cả đều được vận hành dựa trên một mô hình mạnh mẽ, đó là mạng nơ-ron tích chập - Convolutional Neural Networks. Vậy, Convolutional Neural Networks là gì? Cấu trúc và nguyên lý hoạt động của mô hình này có gì đặc biệt giúp nó trở thành cốt lõi của thị giác máy tính? Hãy cùng VNPT AI tìm hiểu ngay trong bài viết này!

Convolutional Neural Networks là gì?

Convolutional Neural Networks (viết tắt là CNN) là một mô hình học sâu (Deep Learning) được thiết kế chuyên biệt để xử lý dữ liệu hình ảnh và thị giác máy tính. CNN hoạt động dựa trên nguyên lý của mạng nơ-ron truyền thống, nhưng điểm khác biệt chính là khả năng tự động trích xuất đặc trưng mà không cần sự can thiệp thủ công từ con người. Nhờ đó, CNN trở thành công cụ có khả năng nhận diện vật thể, phân loại hình ảnh và xử lý video rất hiệu quả, mạnh mẽ.

Trước khi Convolutional Neural Networks ra đời, các phương pháp nhận diện hình ảnh yêu cầu con người phải thực hiện trích xuất đặc trưng bằng tay - một quá trình rất phức tạp và tốn nhiều thời gian. CNN đã thay thế quy trình này bằng cách sử dụng các phép toán của đại số tuyến tính, đặc biệt là tích chập (convolution) và nhân ma trận (matrix multiplication), để tự động nhận diện các đặc điểm trong hình ảnh. Thông qua nhiều lớp xử lý, CNN có thể phát hiện từ các đặc trưng đơn giản như cạnh, góc, màu sắc cho đến những chi tiết phức tạp hơn như hình dạng, kết cấu và toàn bộ đối tượng trong ảnh.

Với khả năng mở rộng và ứng dụng rộng rãi, CNN đang được sử dụng trong nhiều lĩnh vực như thị giác máy tính, chẩn đoán y khoa (phân tích ảnh y tế), nhận diện khuôn mặt trong an ninh và cả xe tự lái. Tuy nhiên, một hạn chế lớn của CNN là yêu cầu tài nguyên tính toán mạnh mẽ (GPU, TPU) để xử lý lượng dữ liệu khổng lồ trong quá trình huấn luyện.

Bên cạnh CNN truyền thống, thế giới cũng đang phát triển các loại convolutional neural networks mới. Một hướng nghiên cứu mới đang nổi lên là mạng nơ-ron tích chập lượng tử (Quantum Convolutional Neural Networks). QCNN sử dụng cơ học lượng tử để tăng tốc độ tính toán và tối ưu hóa hiệu suất trong các bài toán phức tạp. Mặc dù còn đang trong giai đoạn nghiên cứu, nhưng QCNN hứa hẹn sẽ mở ra nhiều đột phá mới trong trí tuệ nhân tạo AI và thị giác máy tính.

>>> Có thể bạn quan tâm: Neural Network là gì? Ứng dụng và vai trò nổi bật của mạng nơ ron nhân tạo

Các lớp cơ bản và nguyên lý hoạt động của Convolutional Neural Networks

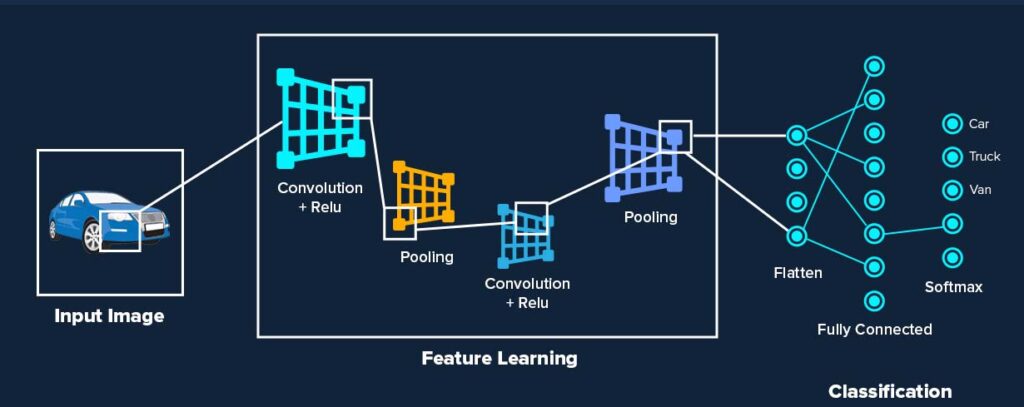

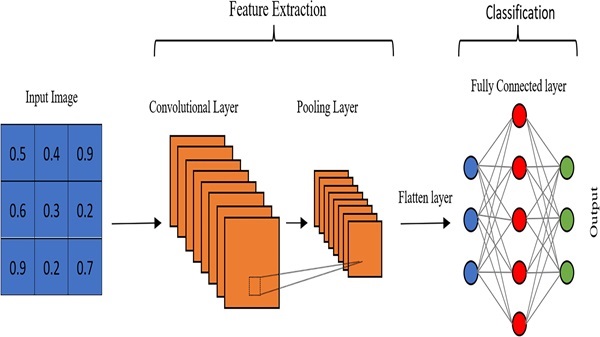

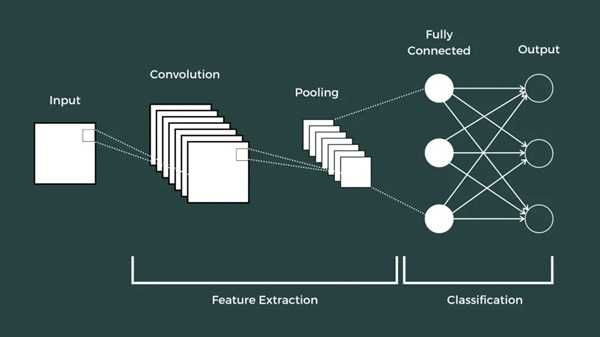

Convolutional Neural Networks hoạt động theo nguyên lý trích xuất và phân tích đặc trưng của dữ liệu đầu vào thông qua nhiều lớp xử lý khác nhau. Vậy các lớp cơ bản trong mạng nơ ron tích chập là gì? Và chúng hoạt động như thế nào? Cùng tìm hiểu chi tiết sau đây:

Convolutional layer

Convolutional layer là lớp tích chập là thành phần quan trọng nhất của CNN, chịu trách nhiệm trích xuất các đặc trưng từ dữ liệu đầu vào. Lớp này sử dụng một bộ lọc (kernel) - một ma trận nhỏ có kích thước phổ biến như 3x3 hoặc 5x5 - quét qua từng vùng nhỏ của hình ảnh và thực hiện phép nhân tích chập (convolution) giữa các giá trị pixel với trọng số của bộ lọc. Kết quả của quá trình này tạo thành bản đồ đặc trưng (feature map), giúp mô hình phát hiện các đặc điểm như cạnh, góc, màu sắc hoặc kết cấu trong ảnh.

Các tham số quan trọng của lớp tích chập bao gồm: Số lượng bộ lọc, Stride (bước di chuyển của bộ lọc) và Padding (giữ kích thước ảnh). Trong đó:

- Stride xác định khoảng cách di chuyển của kernel trên ảnh đầu vào theo cả chiều ngang (trái sang phải) và chiều dọc (trên xuống dưới).

- Padding là quá trình thêm giá trị vào viền ảnh để kiểm soát kích thước feature map, bảo vệ thông tin viền ảnh khi thực hiện tích chập.

Sau mỗi phép tích chập, Convolutional Neural Networks thường áp dụng hàm kích hoạt ReLU (Rectified Linear Unit) để loại bỏ giá trị âm, tăng tính phi tuyến và giúp mô hình học hiệu quả hơn.

.png)

Pooling layer

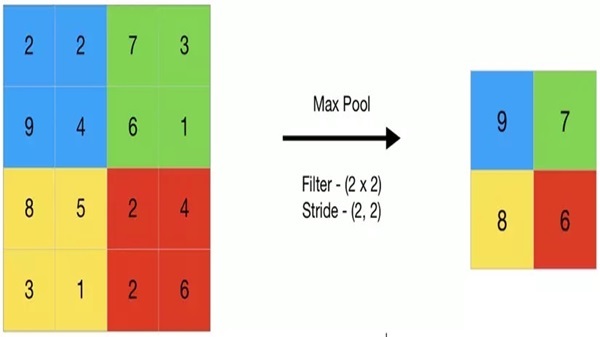

Sau khi trích xuất đặc trưng qua lớp tích chập, Convolutional Neural Networks sử dụng Pooling Layer để giảm kích thước feature map, từ đó giảm số lượng tham số, tăng hiệu suất tính toán và tránh hiện tượng overfitting (mô hình học quá kỹ vào dữ liệu huấn luyện, nhưng lại hoạt động kém khi gặp dữ liệu mới). Pooling hoạt động bằng cách áp dụng một bộ lọc nhỏ (thường là 2x2 hoặc 3x3) để lấy giá trị đại diện cho mỗi vùng quét, giúp giữ lại những thông tin quan trọng nhất.

Có hai phương pháp pooling phổ biến: Max Pooling và Average Pooling.

- Trong Max Pooling, giá trị lớn nhất trong vùng quét sẽ được giữ lại, giúp mô hình tập trung vào những đặc trưng nổi bật nhất.

- Average Pooling tính trung bình các giá trị trong vùng quét, giúp tổng hợp thông tin thay vì chỉ giữ giá trị lớn nhất như Max Pooling.

Mặc dù pooling làm mất đi một số thông tin, nhưng đổi lại, nó giúp mô hình hoạt động hiệu quả hơn, giảm thiểu độ phức tạp và cải thiện khả năng tổng quát hóa đối với dữ liệu mới.

Fully connected layer

Fully connected layer là lớp kết nối đầy đủ nằm ở cuối mạng Convolutional Neural Networks, đóng vai trò tổng hợp tất cả các đặc trưng đã trích xuất và thực hiện nhiệm vụ phân loại hình ảnh. Ở lớp này, mỗi nơ-ron được kết nối với toàn bộ nơ-ron ở lớp trước, tạo nên một mạng lưới liên kết chặt chẽ. Các giá trị từ feature map trước đó sẽ được chuyển thành một vector một chiều, một chuỗi dài duy nhất và đưa vào lớp fully connected để xử lý. Quá trình này được gọi là Làm phẳng Flattening.

Tiếp đó, CNN sử dụng các hàm kích hoạt phi tuyến như Softmax hoặc Sigmoid để tính toán xác suất cho từng lớp đầu ra. Điều này giúp cho mô hình đưa ra quyết định cuối cùng, chẳng hạn như phân loại hình ảnh thành các nhóm khác nhau (ví dụ: chó, mèo, ô tô, v.v.).

Additional layers

Bên cạnh ba lớp chính, CNN có thể bao gồm một số lớp bổ sung để tối ưu hiệu suất và độ chính xác của mô hình.

- Lớp kích hoạt (Activation Layer) giúp tăng khả năng học và tạo tính phi tuyến cho mô hình bằng cách áp dụng các hàm phi tuyến như ReLU, Sigmoid hoặc Tanh.

- Lớp dropout (Dropout Layer) là một kỹ thuật quan trọng để giảm overfitting, bằng cách tạm thời loại bỏ ngẫu nhiên một số nơ-ron trong quá trình huấn luyện, giúp mô hình trở nên linh hoạt và tổng quát hơn.

- Ngoài ra, lớp chuẩn hóa (Batch Normalization Layer) cũng thường được sử dụng để tăng tốc độ huấn luyện và giúp mô hình ổn định hơn bằng cách chuẩn hóa dữ liệu giữa các lớp.

Cấu trúc của mạng nơ ron tích chập

Mạng nơ-ron tích chập có cấu trúc rất đặc biệt, giúp mô hình tự động trích xuất đặc trưng từ dữ liệu hình ảnh mà không cần sự can thiệp thủ công. Vậy cụ thể cấu trúc của convolutional neural networks là gì mà có thể tạo nên hiệu năng mạnh mẽ như vậy?

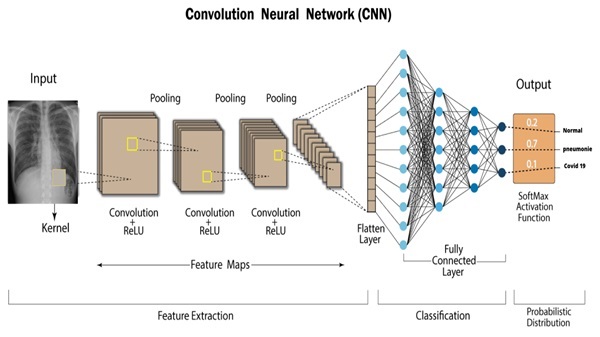

Cơ bản, CNN được xây dựng bằng cách chồng nhiều lớp tích chập (Convolutional Layers), xen kẽ với lớp pooling (Pooling Layers) và kết thúc bằng lớp kết nối đầy đủ (Fully Connected Layers), giúp xử lý và phân loại hình ảnh. Ngoài ra, các hàm kích hoạt phi tuyến (như ReLU, Tanh) được sử dụng để tăng khả năng biểu diễn của mô hình. Mỗi lớp trong CNN đảm nhận một nhiệm vụ cụ thể, từ trích xuất đặc trưng đến giảm kích thước và cuối cùng là phân loại hình ảnh.

Cấu trúc cơ bản của CNN có thể chia thành ba phần chính: trường tiếp nhận cục bộ (Local Receptive Field), trọng số chia sẻ (Shared Weights and Bias) và lớp tổng hợp (Pooling Layer):

- Trường tiếp nhận cục bộ - Local receptive field: Là nơi dữ liệu đầu vào được phân tách thành từng vùng nhỏ để xử lý. Thay vì kết nối toàn bộ các điểm ảnh (pixels) của một hình ảnh với tất cả các nơ-ron ở lớp tiếp theo, CNN chỉ kết nối từng vùng nhỏ (local receptive field) với một nơ-ron nhất định. Như vậy mỗi nơ-ron sẽ chỉ nhận diện đặc trưng của một khu vực cục bộ. Điều này giúp mô hình có khả năng nhận diện các đặc trưng quan trọng theo từng khu vực nhỏ trong ảnh trước khi tổng hợp thành thông tin lớn hơn ở các lớp tiếp theo.

- Trọng số chia sẻ: Giúp giảm đáng kể số lượng tham số cần huấn luyện trong mô hình. Trong một lớp tích chập, các bộ lọc (filters) được quét trên toàn bộ hình ảnh theo cơ chế tích chập (convolution), với mỗi bộ lọc đảm nhận nhiệm vụ phát hiện một đặc trưng cụ thể, chẳng hạn như cạnh, góc, màu sắc hoặc hình dạng. Việc sử dụng chung các trọng số giữa các vùng trong ảnh giúp CNN có thể học được các mẫu đặc trưng một cách hiệu quả và tiết kiệm tài nguyên tính toán.

- Lớp tổng hợp (Pooling Layer): Đóng vai trò giảm kích thước dữ liệu đầu ra, giúp tối ưu mô hình và tránh dư thừa thông tin. Pooling giúp mô hình trở nên bất biến với các thay đổi như dịch chuyển, co giãn hoặc xoay hình ảnh, đảm bảo CNN vẫn có thể nhận diện đúng đối tượng dù chúng xuất hiện ở các vị trí khác nhau trong ảnh. Có hai loại pooling phổ biến: Max Pooling, lấy giá trị lớn nhất trong vùng quét để giữ lại đặc trưng quan trọng nhất, và Average Pooling, tính giá trị trung bình của các điểm trong vùng quét để làm mịn dữ liệu.

Với cơ chế kết hợp giữa các lớp này, Convolutional Neural Networks có khả năng xây dựng biểu diễn trừu tượng từ cấp độ thấp đến cao, từ các đặc điểm đơn giản như cạnh và góc cho đến các hình dạng phức tạp hơn như khuôn mặt hoặc vật thể. Bên cạnh đó, trong suốt quá trình huấn luyện, CNN tự động điều chỉnh các bộ lọc và trọng số thông qua backpropagation, và thuật toán tối ưu hóa, giúp mô hình học cách trích xuất đặc trưng và nhận diện hình ảnh một cách hiệu quả.

Các mô hình CNN phổ biến hiện nay

Mạng nơ-ron tích chập (CNN) đã có nhiều cải tiến đáng kể từ khi ra đời, giúp nâng cao hiệu suất nhận diện hình ảnh và xử lý thị giác máy tính. Nhiều Convolutional Neural Network Architecture (mô hình CNN) đã được phát triển nhằm tối ưu hóa độ chính xác, giảm thiểu số lượng tham số và tăng tốc độ huấn luyện. Cụ thể, những mô hình phổ biến nhất của Convolutional Neural Networks là gì?

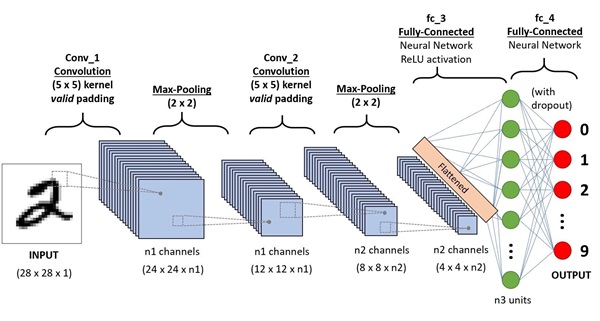

LeNet

LeNet là một trong những mạng nơ-ron tích chập đầu tiên, được phát triển bởi Yann LeCun vào cuối những năm 1989. Mô hình này được thiết kế để nhận diện chữ số viết tay trên tập dữ liệu MNIST, đặt nền tảng quan trọng cho các kiến trúc CNN sau này. Cấu trúc của LeNet bao gồm các lớp tích chập xen kẽ với các lớp pooling, tiếp theo là các lớp kết nối đầy đủ để thực hiện phân loại. Mặc dù LeNet có độ sâu tương đối nhỏ so với các mô hình hiện đại, nhưng nó đã chứng minh hiệu quả của CNN trong việc trích xuất đặc trưng từ hình ảnh và xử lý dữ liệu thị giác.

AlexNet

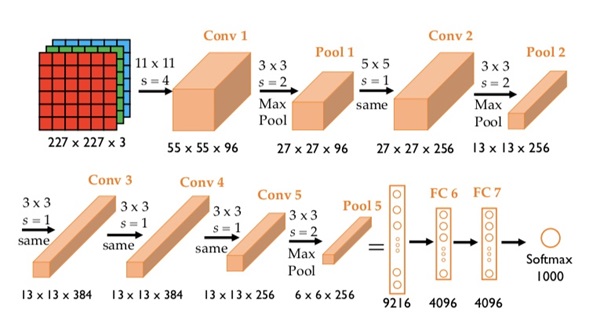

AlexNet được phát triển bởi Alex Krizhevsky, Ilya Sutskever và Geoffrey Hinton vào năm 2012, là Convolutional Neural Network Architecture đầu tiên giành chiến thắng trong cuộc thi ImageNet Large Scale Visual Recognition Challenge (ILSVRC). Đây là bước ngoặt quan trọng giúp Convolutional Neural Networks trở thành công cụ mạnh mẽ trong lĩnh vực nhận diện hình ảnh.

Cấu trúc của AlexNet bao gồm năm lớp tích chập, xen kẽ với ba lớp pooling, sau đó là ba lớp kết nối đầy đủ. Một điểm đột phá của mô hình này là việc sử dụng hàm kích hoạt ReLU, giúp tăng tốc độ huấn luyện đáng kể so với các mô hình trước đó. Ngoài ra, AlexNet cũng áp dụng Dropout để giảm overfitting và sử dụng GPU để tăng tốc tính toán. Thành công của AlexNet đã mở đường cho nhiều mô hình CNN hiện đại sau này.

Resnet

ResNet (Residual Network), được giới thiệu bởi nhóm nghiên cứu của Microsoft vào năm 2015, là một mạng nơ-ron tích chập (CNN) với khả năng huấn luyện các mô hình cực kỳ sâu mà không gặp phải vấn đề suy giảm đạo hàm (vanishing gradient).

Điểm khác biệt chính của ResNet là việc sử dụng skip connections (kết nối tắt), cho phép các thông tin có thể đi qua một số lớp nhất định mà không bị suy giảm. Điều này giúp mạng học được các biểu diễn tốt hơn và cải thiện khả năng tổng quát hóa. ResNet có nhiều phiên bản khác nhau, từ ResNet-18, ResNet-34, ResNet-50 đến ResNet-152, trong đó phiên bản sâu nhất đạt đến 152 lớp. Mô hình này đã giành chiến thắng trong cuộc thi ImageNet 2015 với độ lỗi chỉ 3,57%, thấp nhất trong lịch sử cuộc thi bấy giờ và thậm chí là thấp hơn cả mức nhận diện của con người.

GoogleNet

Khi tìm hiểu về convolutional neural networks là gì? Chắc chắn bạn sẽ bắt gặp GoogleNet, còn được gọi là Inception v1. Mô hình này được phát triển bởi Google và giành chiến thắng trong cuộc thi ImageNet Challenge năm 2014. Đây là một mô hình Convolutional Neural Network nổi bật với khả năng đạt hiệu suất cao trong phân loại hình ảnh mà không cần sử dụng quá nhiều tham số.

GoogleNet sử dụng Inception Modules, một cơ chế giúp mô hình có thể học được nhiều đặc trưng ở các mức độ khác nhau bằng cách áp dụng các bộ lọc có kích thước khác nhau trong cùng một lớp. Tổng cộng mô hình CNN này có 22 lớp (nếu tính cả các lớp gộp là 27), nhưng số lượng tham số ít hơn giúp giảm tải bộ nhớ và tăng tốc độ huấn luyện mà vẫn đạt độ chính xác cao.

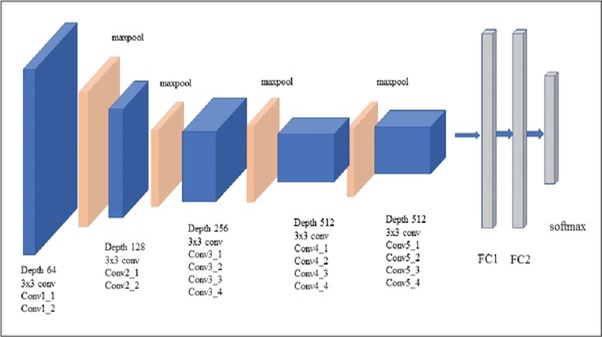

VGG

VGG (Visual Geometry Group), được phát triển bởi nhóm nghiên cứu tại Đại học Oxford, là một mạng nơ-ron tích chập (CNN) sử dụng các bộ lọc 3×3 được xếp chồng lên nhau, tạo nên một kiến trúc đơn giản nhưng rất hiệu quả. Hai phiên bản phổ biến nhất là VGG-16 và VGG-19, với số lượng lớp tích chập lên đến 16 và 19 lớp tương ứng.

Mặc dù VGG đạt được kết quả rất tốt trong nhận diện hình ảnh, nhưng nó có một nhược điểm là số lượng tham số rất lớn (khoảng 138 triệu tham số), khiến mô hình trở nên nặng nề và tốn tài nguyên tính toán. Tuy nhiên, nhờ cấu trúc đồng nhất và khả năng học sâu, VGG vẫn được sử dụng rộng rãi và làm nền tảng cho nhiều nghiên cứu tiếp theo trong thị giác máy tính.

Lợi ích của mạng nơ ron tích chập

Khi tìm hiểu convolutional neural networks là gì, ta thấy rằng mô hình này có khả năng học hỏi và trích xuất đặc trưng từ dữ liệu hình ảnh một cách tự động, giúp nâng cao độ chính xác và hiệu suất trong nhiều ứng dụng thực tế. Cụ thể, những lợi ích quan trọng nhất của mạng nơ-ron tích chập - CNN là gì? Cùng tìm hiểu sau đây:

Khả năng xử lý với độ chính xác cao trong thị giác máy tính

Một trong những ưu điểm lớn nhất của convolutional neural network là khả năng nhận diện hình ảnh và phân loại đối tượng với độ chính xác cao. Nhờ vào cơ chế tích chập (convolution), CNN có thể phân tích dữ liệu hình ảnh theo từng cấp độ, từ các đặc trưng đơn giản như cạnh, góc, đến những đặc điểm phức tạp như hình dạng và kết cấu. Điều này giúp CNN trở thành công cụ mạnh mẽ trong các ứng dụng như nhận diện khuôn mặt, phân loại ảnh y tế, giám sát an ninh và xe tự lái.

Tự động trích xuất đặc trưng, giảm công sức xử lý thủ công

Trước khi CNN ra đời, quá trình trích xuất đặc trưng từ hình ảnh phải được thực hiện thủ công, đòi hỏi nhiều thời gian và công sức của con người. Mạng nơ-ron tích chập (CNN) có khả năng tự động học đặc trưng từ dữ liệu, giúp loại bỏ công đoạn thủ công này. Các lớp tích chập đầu tiên nhận diện các đặc trưng cơ bản, trong khi các lớp sâu hơn xử lý thông tin phức tạp hơn. Điều này làm cho CNN trở thành lựa chọn tối ưu cho các bài toán thị giác máy tính mà không cần thiết lập các quy tắc trích xuất đặc trưng một cách thủ công.

Tái sử dụng mô hình với Transfer Learning

Một lợi thế quan trọng khác của CNN là khả năng tái sử dụng mô hình thông qua Transfer Learning. Các mô hình CNN đã được huấn luyện trước trên tập dữ liệu lớn, như ImageNet, có thể được điều chỉnh để áp dụng vào các bài toán khác với lượng dữ liệu huấn luyện hạn chế. Điều này giúp giảm chi phí tính toán và tăng tốc độ triển khai, đặc biệt trong các lĩnh vực như y tế, nông nghiệp và công nghiệp sản xuất, nơi dữ liệu huấn luyện có thể bị giới hạn.

>>> Có thể bạn quan tâm: Transfer Learning là gì? Lợi ích và ứng dụng của học chuyển giao

Hiệu suất cao nhờ chia sẻ tham số

Khác với mạng nơ-ron truyền thống có lớp kết nối đầy đủ, CNN sử dụng cơ chế chia sẻ tham số (parameter sharing) thông qua các bộ lọc (filters). Nhờ đó, số lượng tham số cần huấn luyện giảm đáng kể, giúp tối ưu hóa quá trình tính toán và tăng hiệu suất xử lý. Điều này cho phép mạng nơ-ron tích chập (CNN) hoạt động hiệu quả trên nhiều thiết bị khác nhau, từ máy chủ có GPU mạnh mẽ đến các thiết bị di động như điện thoại thông minh hay hệ thống tính toán biên (edge computing).

Khả năng tổng quát hóa cao, giảm overfitting

CNN có khả năng học và tổng quát hóa rất tốt nhờ vào việc sử dụng Pooling Layer và các kỹ thuật như Dropout. Pooling Layer giúp giảm kích thước của dữ liệu đầu ra, loại bỏ thông tin dư thừa và làm cho mô hình trở nên bất biến với các thay đổi như dịch chuyển, co giãn hay xoay hình ảnh. Ngoài ra, Dropout giúp giảm overfitting bằng cách vô hiệu hóa ngẫu nhiên một số nơ-ron trong quá trình huấn luyện, làm cho mô hình linh hoạt hơn khi gặp dữ liệu mới.

Ứng dụng của Convolutional Neural Networks trong thực tế

Nhờ vào khả năng trích xuất đặc trưng tự động và nhận diện hình ảnh với độ chính xác cao, mạng nơ-ron tích chập (CNN) đã xuất hiện rộng rãi trong nhiều lĩnh vực quan trọng như y tế, ô tô tự lái, mạng xã hội, thương mại điện tử và trợ lý ảo. Vậy những ứng dụng thực tế của convolutional neural networks là gì?

Y tế - Hỗ trợ chẩn đoán và phân tích hình ảnh y khoa

Một trong những ứng dụng quan trọng nhất của mạng nơ-ron tích chập là trong lĩnh vực y tế, nơi Convolutional Neural Networks được sử dụng để phân tích hình ảnh y khoa và hỗ trợ bác sĩ trong quá trình chẩn đoán bệnh. Các mô hình CNN có thể phát hiện các dấu hiệu bất thường trong ảnh X-quang, MRI, CT scan và cả hình ảnh mô bệnh học. Chẳng hạn, CNN giúp nhận diện khối u trong ảnh chụp não, xác định tổn thương phổi trong X-quang phổi hoặc đánh giá mức độ tổn thương võng mạc trong bệnh tiểu đường. Nhờ khả năng phân tích nhanh chóng và chính xác, CNN không chỉ hỗ trợ bác sĩ đưa ra chẩn đoán sớm mà còn giúp nâng cao hiệu quả điều trị.

Ngành ô tô - Cốt lõi cho sự phát triển của công nghệ xe tự lái

Convolutional Neural Networks đóng vai trò quan trọng trong sự phát triển của xe tự lái với khả năng giúp xe nhận diện và phân tích môi trường xung quanh thông qua dữ liệu từ camera và cảm biến. Các mô hình CNN có thể phát hiện làn đường, nhận diện biển báo giao thông, phát hiện người đi bộ và phương tiện khác, từ đó giúp hệ thống điều hướng xe an toàn. Ngoài ra, CNN cũng được sử dụng trong các tính năng hỗ trợ lái xe, như hệ thống kiểm soát hành trình thông minh, hỗ trợ đỗ xe tự động và cảnh báo va chạm, giúp cải thiện trải nghiệm lái xe và nâng cao mức độ an toàn.

Mạng xã hội - Phân tích hình ảnh và kiểm duyệt nội dung

Các nền tảng mạng xã hội sử dụng mạng nơ-ron tích chập (CNN) để xử lý hình ảnh và tối ưu hóa trải nghiệm người dùng. Một trong những ứng dụng phổ biến nhất là nhận diện khuôn mặt, giúp các nền tảng như Facebook, Instagram gợi ý gắn thẻ (tag) bạn bè trong ảnh. Ngoài ra, CNN còn được sử dụng để phát hiện nội dung không phù hợp hoặc vi phạm chính sách, chẳng hạn như hình ảnh bạo lực, nội dung phản cảm hoặc tin giả, giúp duy trì môi trường mạng an toàn hơn.

Thương mại điện tử - Tìm kiếm sản phẩm bằng hình ảnh

Convolutional Neural Networks đã thay đổi cách người dùng mua sắm trực tuyến bằng việc cho phép tìm kiếm sản phẩm bằng hình ảnh thay vì nhập từ khóa văn bản. Ví dụ, khi khách hàng tải lên hình ảnh của một đôi giày hoặc một chiếc váy, hệ thống sử dụng CNN để phân tích và tìm các sản phẩm có hình dạng, màu sắc tương tự trên trang web. Ngoài ra, CNN cũng giúp cải thiện các tính năng gợi ý sản phẩm theo đúng mong muốn của khách hàng bằng cách nhận diện sở thích của người mua thông qua các hình ảnh họ đã xem hoặc tìm kiếm trước đó. Điều này giúp các nền tảng thương mại điện tử tối ưu hóa trải nghiệm mua sắm và tăng tỷ lệ chuyển đổi.

Trợ lý ảo - Nhận diện giọng nói và hiểu lệnh người dùng

Mặc dù Convolutional Neural Networks chủ yếu được sử dụng để xử lý dữ liệu hình ảnh, nhưng nó cũng có thể được áp dụng trong những lĩnh vực khác như xử lý âm thanh, đặc biệt là nhận diện giọng nói. Các trợ lý ảo như Google Assistant, Siri, Alexa sử dụng CNN để phân tích và nhận diện các từ khóa trong câu lệnh của người dùng, giúp cải thiện khả năng hiểu và phản hồi một cách chính xác. Nhờ vào CNN, các trợ lý ảo có thể tự động phân biệt giọng nói của mỗi người, tạo cách phát âm riêng biệt và cải thiện khả năng phản hồi theo ngữ cảnh.

Hướng dẫn lựa chọn tham số tham số cho CNN

Tìm hiểu convolutional neural networks là gì, có thể thấy được một đặc điểm rằng hiệu suất của mô hình CNN phụ thuộc rất nhiều vào việc lựa chọn tham số phù hợp hay không. Việc điều chỉnh đúng các tham số này giúp tối ưu hóa hiệu suất, tăng độ chính xác và tránh tình trạng overfitting hoặc underfitting. Dưới đây là hướng dẫn chi tiết để lựa chọn các tham số quan trọng cho CNN:

Số lượng lớp tích chập (Convolution Layer)

Số lượng convolution layer ảnh hưởng trực tiếp đến khả năng học của mô hình. Các lớp tích chập đầu tiên sẽ nhận diện những đặc trưng cơ bản như cạnh, góc, trong khi các lớp sâu hơn sẽ xử lý thông tin phức tạp hơn như hình dạng và kết cấu. Nếu mô hình quá nông (ít lớp), nó có thể không đủ mạnh để trích xuất đầy đủ các đặc trưng cần thiết, dẫn đến hiệu suất thấp. Ngược lại, nếu mô hình quá sâu (nhiều lớp), nó có thể dễ gặp phải vanishing gradient, làm giảm khả năng học hiệu quả.

Vì vậy, khi xem xét số lượng lớp tích chập trong Convolutional Neural Networks cần lưu ý:

- Với các bài toán nhận diện ảnh thông thường, chỉ cần 3 - 5 lớp tích chập là đủ để đạt kết quả tốt.

- Đối với các mô hình lớn hơn như ResNet hoặc VGG, số lượng lớp có thể lên tới hàng chục, thậm chí hàng trăm lớp, nhưng cần có kỹ thuật skip connection hoặc batch normalization để giúp mô hình hội tụ tốt hơn.

Kích thước bộ lọc (Filter Size)

Bộ lọc (kernel) là thành phần chính trong quá trình tích chập, giúp mô hình trích xuất đặc trưng từ ảnh. Bộ lọc nhỏ (3x3) thường được sử dụng vì nó có khả năng nắm bắt chi tiết tốt hơn mà không làm tăng quá nhiều số lượng tham số. Trong khi đó, bộ lọc lớn hơn (5x5 hoặc 7x7) có thể giúp nhận diện các đặc trưng rộng hơn, nhưng đồng thời làm tăng số lượng tham số và độ phức tạp tính toán.

Một số cách lựa chọn kích thước bộ học phù hợp trong Convolutional Neural Networks bao gồm:

- Bộ lọc 3x3 là lựa chọn phổ biến nhất vì nó cân bằng giữa hiệu suất và tốc độ tính toán.

- Bộ lọc 5x5 có thể được sử dụng khi cần phát hiện các đặc trưng lớn hơn, nhưng thường chỉ được áp dụng ở các lớp đầu tiên của mô hình.

- Nếu muốn giảm tải tính toán nhưng vẫn giữ được khả năng trích xuất đặc trưng, có thể sử dụng nhiều bộ lọc 3x3 liên tiếp thay vì một bộ lọc lớn hơn.

Kích thước Pooling Layer

Pooling Layer giúp giảm kích thước đầu ra của các lớp tích chập, giảm số lượng tham số và tăng khả năng tổng quát hóa của mô hình. Trong đó, Max Pooling thường được sử dụng nhiều hơn so với Average Pooling vì nó giữ lại giá trị nổi bật nhất trong vùng quét, giúp mô hình tập trung vào các đặc trưng quan trọng. Kích thước pooling phổ biến nhất là 2x2, giúp giảm kích thước đầu ra xuống một nửa mà vẫn giữ lại thông tin quan trọng

Vậy, kích thước Pooling phù hợp nhất trong convolutional neural networks là gì?

- Sử dụng Max Pooling với kích thước 2x2 cho các bài toán nhận diện ảnh thông thường.

- Với ảnh có độ phân giải cao hoặc khi cần giảm nhanh kích thước feature map, có thể thử pooling 4x4, nhưng cần kiểm tra xem có mất quá nhiều thông tin hay không.

Số lần huấn luyện (Epochs) và chia tập dữ liệu (Train/Test Split)

Số lần huấn luyện (epochs) ảnh hưởng đến khả năng mô hình học từ dữ liệu. Nếu số epochs quá ít, mô hình có thể chưa học được đủ đặc trưng quan trọng và dẫn đến underfitting. Ngược lại, nếu số epochs quá nhiều, mô hình có thể học quá sâu vào dữ liệu huấn luyện và dẫn đến overfitting.

Do đó, bạn nên tham khảo các tham số sau:

- Bắt đầu với 10-50 epochs, sau đó theo dõi độ lỗi (loss) và độ chính xác (accuracy) trên tập validation để điều chỉnh.

- Nếu thấy mô hình đạt độ chính xác cao trên tập huấn luyện nhưng thấp trên tập kiểm tra, có thể sử dụng kỹ thuật early stopping để ngừng huấn luyện khi mô hình bắt đầu có dấu hiệu overfitting.

- Chia tập dữ liệu thành 80% train - 20% test hoặc 70% train - 15% validation - 15% test để đảm bảo đánh giá mô hình chính xác nhất.

Thách thức và hạn chế của mạng nơ ron tích chập

Mặc dù mạng nơ-ron tích chập (CNN) là một trong những công nghệ tiên tiến nhất trong trí tuệ nhân tạo, đặc biệt trong lĩnh vực thị giác máy tính, nhưng nó vẫn tồn tại một số thách thức và hạn chế nhất định. Cụ thể khó khăn của convolutional neural networks là gì?

- Yêu cầu tài nguyên tính toán lớn: Khi nói tới nhược điểm lớn nhất của mạng nơ-ron tích chập là gì? Chắc chắn phải kể đến yêu cầu về tài nguyên tính toán. Việc huấn luyện Convolutional Neural Networks, đặc biệt là các mô hình sâu như ResNet, VGG hay GoogleNet, đòi hỏi GPU hoặc TPUs mạnh mẽ để xử lý hàng triệu tham số. Điều này làm tăng chi phí triển khai và hạn chế khả năng áp dụng CNN trên các thiết bị có cấu hình thấp.

- Cần lượng dữ liệu lớn để huấn luyện: CNN hoạt động hiệu quả khi có lượng dữ liệu huấn luyện lớn, đặc biệt là dữ liệu có gán nhãn. Điều này gây khó khăn cho các bài toán mà dữ liệu bị giới hạn hoặc tốn nhiều thời gian, chi phí để thu thập và gán nhãn. Nếu tập dữ liệu không đủ phong phú, mô hình có thể gặp vấn đề overfitting, dẫn đến khả năng tổng quát hóa kém trên dữ liệu mới.

- Độ phức tạp cao, khó huấn luyện: So với các mô hình học máy truyền thống, Convolutional Neural Networks có cấu trúc phức tạp với nhiều tham số cần tinh chỉnh, như số lượng lớp, kích thước bộ lọc, hàm kích hoạt, tốc độ học (learning rate), batch size. Nếu không được tối ưu đúng cách, mô hình có thể hội tụ chậm hoặc không hội tụ, gây lãng phí tài nguyên tính toán mà không đạt hiệu suất mong muốn.

- Khó giải thích và kiểm soát kết quả: Một trong những thách thức lớn của Convolutional Neural Networks là vấn đề giải thích mô hình (interpretability). CNN hoạt động như một “hộp đen” (black box), khiến việc hiểu cách mô hình đưa ra quyết định trở nên khó khăn. Điều này đặc biệt quan trọng trong các lĩnh vực yêu cầu tính minh bạch cao như y tế, tài chính hoặc pháp lý, nơi con người cần hiểu rõ lý do một dự đoán được đưa ra.

- Dễ gặp vấn đề overfitting nếu không kiểm soát tốt: Convolutional Neural Networks có thể dễ bị overfitting, đặc biệt khi dữ liệu huấn luyện không đủ đa dạng hoặc quá phức tạp so với tập dữ liệu kiểm tra. Nếu không áp dụng các kỹ thuật Dropout, Regularization, Data Augmentation, mô hình có thể hoạt động rất tốt trên tập huấn luyện nhưng lại có độ chính xác thấp khi gặp dữ liệu mới.

Tạm kết

Trong bài viết trên, VNPT AI đã mang tới những nội dung cơ bản nhất xoay quanh khái niệm Convolutional Neural Networks là gì, cũng như cách xây dựng và tối ưu hóa mô hình CNN hiệu quả. Dù CNN vẫn còn tồn đọng nhiều thách thức trong quá trình triển khai, nhưng với các phương pháp tối ưu hóa như điều chỉnh tham số, sử dụng Transfer Learning hay Regularization đang dần được hoàn thiện hơn từng ngày và phát huy tối đa các thế mạnh của mình trong rất nhiều ngành nghề như y tế, giao thông vận tải, tài chính,...

Tin mới nhất

VNPT AI

Hãy trở thành đối tác của chúng tôi ngay hôm nay để được sử dụng những dịch vụ hàng đầu!

Gửi lời nhắnĐánh Giá

Các bài viết liên quan